محافظت از تصاویر در برابر دستکاریهای هوش مصنوعی با کمک تکنیک جدید MIT

محققان MIT تکنیک جدیدی طراحی کردهاند با نام PhotoGuard که با ایجاد ماسکهای نامرئی مانع از تحریف تصاویر توسط سیستمهای هوش مصنوعی میشود و به حفظ حریم خصوصی افراد از این طریق کمک مینماید.

به گزارش هوشیو، تیمی از محققان MIT تکنیک جدیدی به نام PhotoGuard ایجاد کردهاند که هدف آن جلوگیری از دستکاری غیرمجاز تصاویر توسط سیستمهای هوش مصنوعی است.

مدلهای تولید تصویر هوش مصنوعی مانند Midjourney و Stable Diffusion را میتوان برای ویرایش تصاویر موجود استفاده کرد و بدون نیاز به مهارتی خاص، با افزودن نواحی جدید به عکس از طریق رنگآمیزی، برش دادن اشیا و ترکیب مجدد آنها با اشیا دیگر (مانند گرفتن صورت یک شخص و قرار دادن آن بر روی تصویر دیگری)، آنها را تغییر داد.

دانشمندان MIT تکنیک جدیدی ایجاد کردهاند که اساساً یک ماسک محافظ است و میتواند از دستکاری تصاویر توسط سیستمهای هوش مصنوعی جلوگیری نماید. این ماسکها توسط چشم انسان قابل مشاهده نیست، اما با تغییر بخشی از پیکسلهای داخل عکس، خروجی تصویر را برای هوش مصنوعی غیرقابل تشخیص مینماید.

محققان در مقالهای نوشتند:«با ایمنسازی تصویر اصلی، قبل از اینکه دیگران بتوانند به آن دسترسی داشته باشند، امکان اعمال تغییر و ویرایش بر روی آن برای هر کسی دشوار میشود.»

PhotoGuard اکنون تحت مجوز MIT در GitHub در دسترس است. مجوز MIT به PhotoGuard اجازه میدهد تا برای مقاصد تجاری از آن استفاده شود، اما این امر مستلزم حفظ حق نسخهبرداری و سایر اعلامیههای مربوط به مجوز است.

هدف از طراحی PhotoGuard، بهبود تشخیص دیپفیکها است که ویدیوها یا تصاویر دستکاری شدهای هستند که تشخیص آنها از واقعی بسیار دشوار است. تیم پشتیبان PhotoGuard معتقد است که اضافه کردن واترمارک کافی نیست، زیرا هنوز هم میتوان تصاویر را قبل از اضافه شدن واترمارک تغییر داد، اما با محافظت از تصاویر در برابر دستکاری در وهله اول، میتوان از وقوع حملات دیپ فیک و ساخت تصاویر جعلی در همان ابتدا جلوگیری کرد.

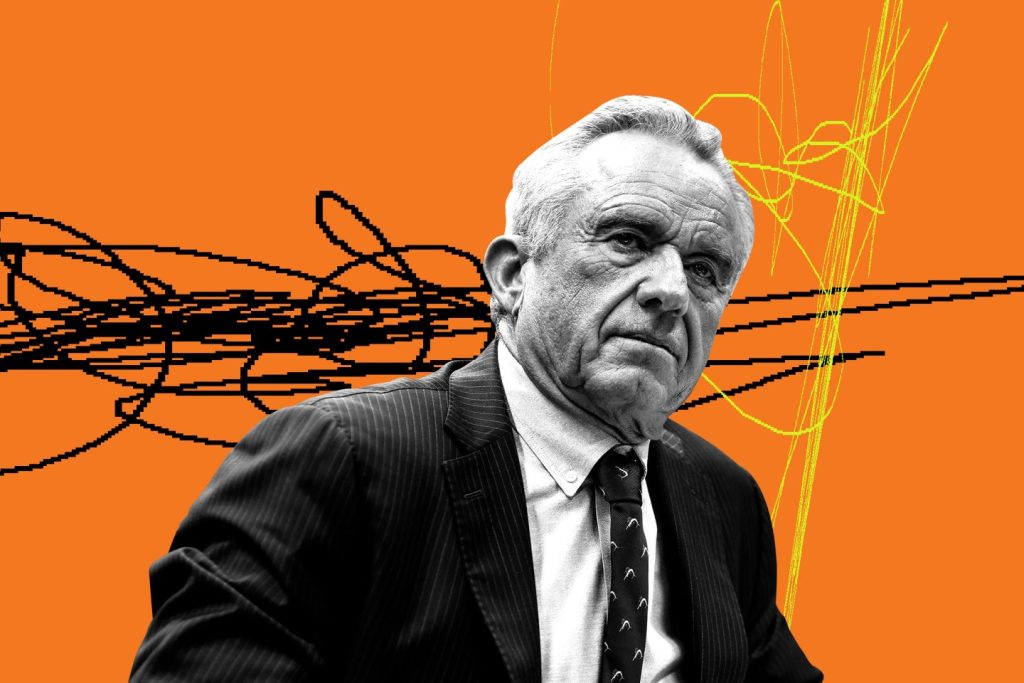

با رایجتر شدن استفاده از مدلهای تصویر هوش مصنوعی مانند DALL-E و Stable Diffusion، به نظر میرسد موارد سوءاستفاده از این مدلها بهویژه در رسانههای اجتماعی نیز افزایش مییابد. به عنوان مثال، کمپین انتخاباتی ران دیسانتیس با استفاده از تصاویر تولید شده توسط هوش مصنوعی، پرزیدنت ترامپ و دکتر فائوچی را در حالتی بحث برانگیز با یکدیگر نشان میدهد. این اتفاق بیانگر آن است که در صورت استفاده غیر مسئولانه از تصاویر تولیدشده توسط هوش مصنوعی، ممکن است مشکلاتی به وجود بیاید.

بر این اساس، نیاز به شناسایی آثار تولید شده توسط هوش مصنوعی در حال افزایش است و در حالی که تشخیص این تصاویر تولیدشده برای متخصصان این حوزه آسان است، اما برخی از تیمهای تحقیقاتی در تلاش هستند تا این کار را برای همه افراد آسانتر نمایند.