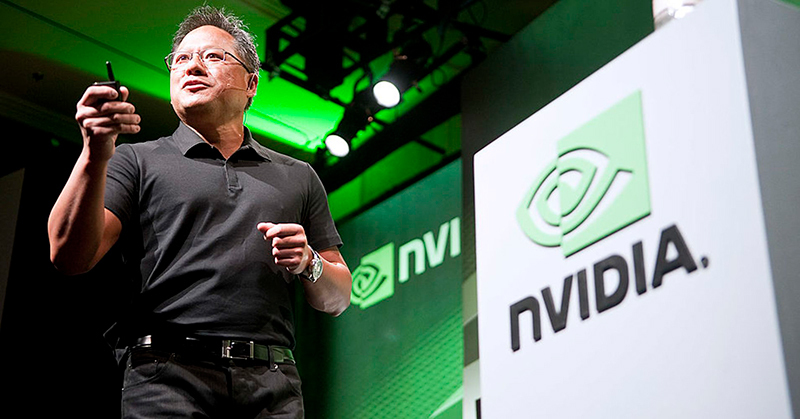

مدلهای زبانی بزرگ NVIDIA در دسترس کسبوکارها قرار میگیرند

NVIDIA بستری برای کسبوکارهای سراسر جهان فراهم آورده است تا بتوانند مدلهای زبانی بزرگ (LLM) را طراحی و مستقر کنند. کسبوکارها با تکیه بر این طراحی میتوانند رباتهای سخنگوی ویژه حوزههای خاص، دستیارهای شخصی و دیگر سیستمهای هوش مصنوعی توسعه دهند.

شرکت NVIDIA به تازگی چارچوب NeMo Megatron را عرضه کرد؛ با استفاده از این چارچوب، میتوان مدلهای زبانی متشکل از تریلیونها پارامتر را آموزش داد. افزون بر این، نرمافزار Triton Inference Server (محصول شرکت NVIDIA) در زبانها و حوزههای جدید از استنتاج توزیعی و چندگِرهی پشتیبانی میکند. هنگامی که از این نرمافزار در کنار سیستمهای DGX (محصول NVIDIA) استفاده شود، میتوانند راهکارهایی در سطح سازمانس ارائه دهند و ساخت و استقرار مدلهای زبانی بسیار بزرگ را آسان کنند.

[irp posts=”18980″]به گفته برایان کاتانزارو ، معاون تیم تحقیقاتی یادگیری عمیق کاربردی در شرکت NVIDIA، «مدلهای زبانی بزرگ انعطافپذیری و کارایی خود را ثابت کردهاند. این مدلها میتوانند به سؤالات تخصصی حوزههای مختلف پاسخ دهند، اسناد را درک کنند و خلاصه کنند و داستان و برنامههای محاسباتی بنویسند. این مدلها تمامی این مسائل را بدون اینکه آموزش خاصی ببینند یا تحت نظارت باشند، انجام میدهند. شاید بتوان گفت مهمترین کاربردی که ابررایانش تا به امروز داشته، توسعه مدلهای زبانی بزرگ برای زبانها و حوزههای جدید بوده است و هماکنون، این قابلیتها در دسترس شرکتهای سراسر جهان قرار گرفتهاند.»

افزایش سرعت توسعه LLMها

NeMo Megatron بر پایه Megatron استوار است؛ Megatron چارچوبی متن باز است که مدلهای زبانی بزرگ و مبتنی بر معماری ترنسفورمر را به اجرا در میآورد. این چارچوب به کوشش پژوهشگران NVIDIA ساخته شده است. Megatron از 530 میلیارد پارامتر تشکیل شده است. این مدل زبانی، بیشترین قابلیت سفارشیسازی را در جهان دارد.

شرکتها با استفاده از چارچوب NeMo Megatron میتوانند بر موانعی که بر سر راه توسعه مدلهای پردازش زبان طبیعی وجود دارد، غلبه کنند. این چارچوب به گونهای طراحی شده است که در زیرساخت محاسباتی، بزرگمقیاس و شتابدادهشده NVIDIA موسوم به DGX SuperPOD گسترش پیدا میکند (Scale out). Nemo Megatron با تکیه بر کتابخانههای پردازشداده که دادهها را تحلیل، گزینش، طبقهبندی و پاکسازی میکنند، فرایند دشوار آموزش LLMها را به صورت خودکار در میآورد.

[irp posts=”4147″]فناوریهای قدرتمند موازیسازی داده، تنسور و پایپلاین موجب میشود، آموزش مدلهای زبانی بسیار بزرگ به نحوی مؤثر میان هزاران GPU توزیع شوند. شرکتها با استفاده از چارچوب NeMo Megatron میتوانند LLMها را متناسب با موضوعات و زبانهای موردنظر خود، آموزش دهند.

استنتاج آنی LLM

Triton Inference Server قابلیت چندگِرهی و چند GPUای دارد و با تکیه بر همین قابلیتها استنتاج حجمی را که LLM باید انجام دهد، میان چندین GPU و گِره توزیع میکند. یک GPU واحد نمیتواند حافظه موردنیاز برای این مدلها را تأمین کند. سِرور بزرگی با چندین GPU میتواند حافظه موردنیاز برای این مدلها را فراهم کند و استنتاج باید به سرعت برای برنامهها انجام شود. Megatron که 530 میلیارد پارامتر دارد، درحالحاضر، ممکن است بر روی دو سیستم DGX اجرا شود و مدت زمان پردازش را از یک دقیقه بر روی سرور CPU به سی ثانیه کاهش دهد و بدین ترتیب، استقرار LLMها را برای کاربردهای آنی میسر کند.

مدلهای زبانی سفارشی

SiDi، JD Explore Academy و VinBrain جزء اولین شرکتهایی هستند که با استفاده از DGX SuperPOD مدلهای زبانی بسیار بزرگ ساختهاند. SiDi یکی از سازمانهای پیشرو در زمینه تحقیق و توسعه حوزه هوش مصنوعی در برزیل است؛ این سازمان، دستیار مجازی سامسونگ را برای 200 میلیون گویشور پرتغالی اصلاح و شخصیسازی کرده است.

به گفته جان یی ، مدیرعامل SiDi، «تیم SiDi تجربه و مهارت زیادی در زمینه توسعه رباتهای سخنگو و دستیاران مجازی هوش مصنوعی دارند؛ لازمه ساخت این دو عملکرد عالی هوش مصنوعی و نرمافزاری تخصصی است که با تغییرات ظریف زبان طبیعی آموزش دیده و به صورت دقیق تنظیم شده است. سیستم DGX SuperPOD برای پیشبرد پروژههای پیشرفته تیم ما مناسب است و ما را قادر میسازد، سرویسهای هوش مصنوعی به گویشوران برزیلی- پرتغالی عرضه کنیم.»

[irp posts=”11632″]JD Explore Academy، بخش تحقیق و توسعه JD.com، (یکی از ارائهدهندگان پیشگام سرویس و فناوری) قصد دارد با استفاده از DGX SuperPOD یک سرویس پردازش زبان طبیعی توسعه دهد و آن را در خدمات هوشمند مشتریان، خردهفروشی هوشمند، لجستیک هوشمند، اینترنت اشیا، بهداشت و درمان و غیره به کار گیرد.

شرکت VinBrain، فعال در زمینه بهداشت و درمان هوشمند واقع در ویتنام، با استفاده از DGX SuperPOD در 100 بیمارستان یک مدل زبانی بالینی برای رادیولوژیستها و پزشکی از راه دور توسعه داده و مستقر کرده است. درحالحاضر، بیش از 600 نفر از کادر درمان از این مدل زبانی استفاده میکنند.

دسترسی به Triton

برای دسترسی به Triton میتوانید از طریق کاتالوگ NGC اقدام کنید. NGC یک منبع کد (repo) برای آن دسته از نرمافزارهای هوش مصنوعی است که با GPU شتاب داده شدهاند و شامل چارچوبها، جعبهابزارها، مدلهای از پیش آموزشدادهشده و نوتبوکهای Jupyter است. علاوه بر این، از طریق منبع کد گیتهاب Triton نیز میتوانید به این نرمافزار دسترسی پیدا کنید. Triton یکی از اجزای پشته نرمافزاری AI Enterprise شرکت NVIDIA است که NVIDIA آن را بهینهسازی، تأیید و پشتیبانی میکند. در نتیجه، شرکتها میتوانند با استفاده از این پشته نرمافزاری، استنتاج مدل زبانی را بر روی سِرورهای شتابیافته موجود در مراکز داده و فضاهای ابریِ خصوصی اجرا کنند.

جدیدترین اخبار هوش مصنوعی ایران و جهان را با هوشیو دنبال کنید