حتی هوشمندترین مدل های هوش مصنوعی هم قادر به رقابت با پردازش دیداری انسانها نیستند

هوشمندترین مدل های هوش مصنوعی از جمله شبکههای عصبی کانولوشنی عمیق (DCNN) نمیتوانند مانند انسانها، از ادراک اشکال ساختاری برای دیدن اشیاء استفاده کنند و به گفته جیمز الدر، استاد دانشگاه یورک، این نکته میتواند در کاربردهای هوش مصنوعی در دنیای واقعی مشکلزا و حتی خطرناک باشد.

الدر، استاد بینایی کامپیوتری و انسانی دانشگاه یورک و یکی از مدیران مرکز هوش مصنوعی و جامعه، به همراه نیکولاس بیکر، از لایولا کالج شیکاگو، بهتازگی مقالهای تحت عنوان «Deep learning models fail to capture the configural nature of human shape perception» را در ژورنال iScience به چاپ رساندهاند.

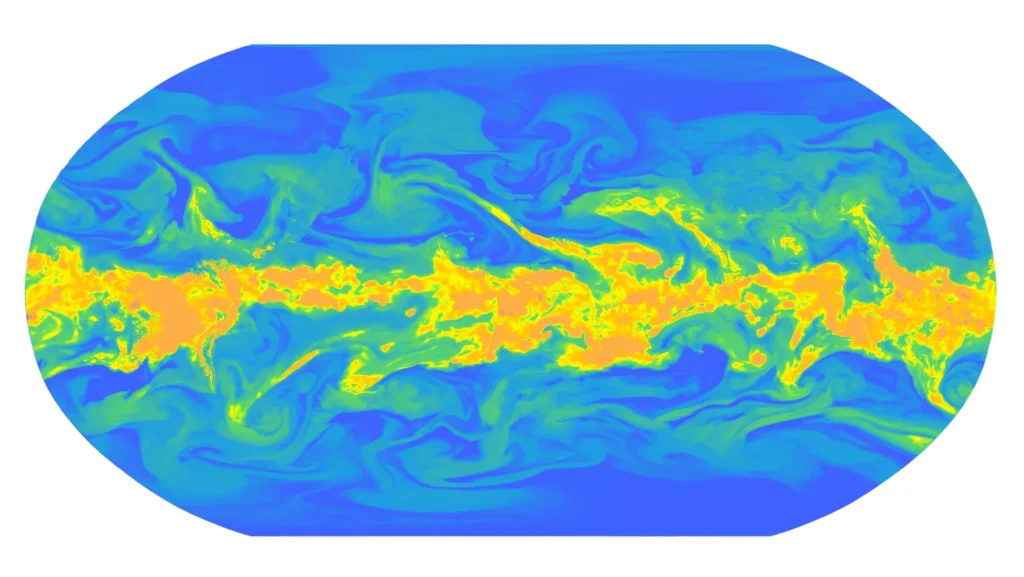

این پژوهش از دسته نوینی از محرکهای دیداری به نام «فرانکشتاین» استفاده میکند، تا دریابد مغز انسان و DCNNها چطور ویژگیهای ظاهری و کلی اشیاء را وارسی میکنند.

الدر توضیح میدهد: «فرانکشتینها اشیائی هستند که به تکههای متعدد تقسیم شده و به اشتباه کنار هم قرار گرفتهاند. به همین خاطر، ویژگیهای محلی درست را در مناطق اشتباه نمایش میدهند.»

مطالعات نشان دادند که فرانکشتاینها سیستم بینایی انسانها را سردرگم میکنند، ولی بر DCNNها تأثیری ندارند؛ امری که حاکی از عدم حساسیت به خواص ساختاری اشیاء است.

الدر ادامه میدهد: «بر اساس یافتهها میتوان دریافت که چرا هوشمندترین مدل های هوش مصنوعی در بعضی موقعیتها شکست میخورند. به علاوه، حالا متوجه شدهایم که برای درک فرایند پردازش دیداری در مغز، باید مسائلی فراتر از شناسایی شیء را در نظر بگیریم. DCNNها معمولاً برای حل مسائل تشخیصی پیچیده، میانبر میزنند. این میانبرها خیلی اوقات به پاسخ میرسند، اما در کاربردهای دنیای واقعی کاربردی نداشته و حتی میتوانند خطرناک باشند.»

به عنوان یکی از این کاربردها میتوان به سیستمهای ویدئویی امنیت جاده اشاره کرد. الدر در این باره توضیح میدهد: «اشیاء موجود در جادههای شلوغ، یعنی خودروها، دوچرخهها و عابران پیاده، مدام راه یکدیگر را سد میکنند و به صورت قطعات ناپیوسته جلوی چشم راننده قرار میگیرند. مغز باید این قطعات را بهدرستی دستهبندی کند، تا انواع اشیاء و موقعیتشان را تشخیص دهد. سیستم هوش مصنوعی که برای نظارت بر امنیت جاده به کار میرود، هر یک از قطعات را به صورت مجزا ادراک میکند و به همین دلیل، نهتنها عملکرد خوبی از خود نشان نمیدهد، بلکه خطرات احتمالی موجود در جاده را نیز به اشتباه درک میکند.» مطالعات پژوهشگران نشان داد که تغییر معماری و فرایند آموزش شبکهها برای اینکه شباهت بیشتری به مغز انسانها پیدا کنند، به پردازش ساختاری (همچون مغز انسان) نمیانجامد و هیچیک از شبکههای تغییریافته نتوانستهاند از فرایند ادراک مغز انسانها تقلید کنند. الدر میگوید: «طبق برآوردهای ما، شبکهها میبایست برای دستیابی به حساسیت ساختاری در سطح مغز انسان، طوری آموزش ببینند که از تشخیص دستهبندیها فراتر رفته و طیف گستردهتری از مسائلی شیئی را حل کنند.»

جدیدترین اخبار هوش مصنوعی ایران و جهان را با هوشیو دنبال کنید