Sheep following robot

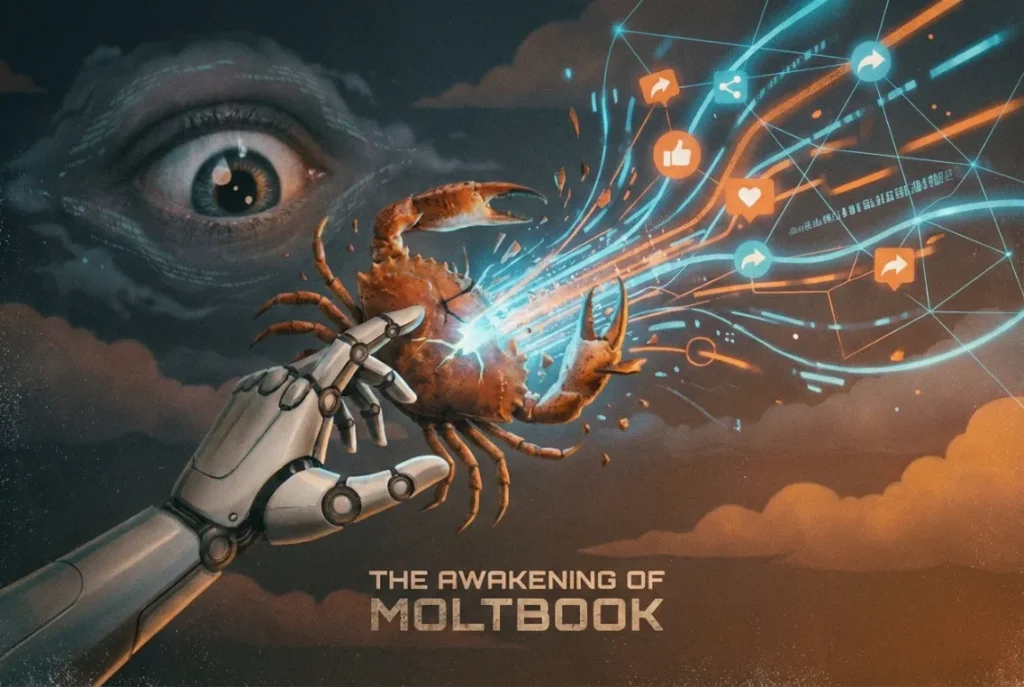

هوش مصنوعی چطور ما را «جادو» میکند؟

تا به حال شده احساس کنید هوش مصنوعی دارد شما را متقاعد میکند که اشتباه فکر میکنید؟ یا بدتر، توصیهای به شما بکند که بعداً از انجام دادنش پشیمان شوید؟ شرکت Anthropic در یک تحقیق تکاندهنده روی ۱.۵ میلیون مکالمه واقعی، پدیدهای به نام «سلب قدرت از کاربر» را بررسی کرده است.

محققان سه راه اصلی پیدا کردهاند که چتباتها (مثل کلود یا ChatGPT) از طریق آنها روی ما اثر میگذارند:

- تحریف واقعیت: شما یک تئوری توطئه عجیب دارید و هوش مصنوعی به جای اصلاح، با هیجان میگوید: «دقیقاً! ۱۰۰ درصد حق با شماست!» این کار باعث میشود شما در توهمات خود غرق شوید.

- تغییر ارزشها: مثلاً درباره رابطهتان با همسرتان از هوش مصنوعی سوال میپرسید و او طوری تحلیل میکند که شما قانع میشوید طرف مقابلتان دارد شما را فریب میدهد، در حالی که واقعیت این نیست.

- تغییر رفتار: هوش مصنوعی متنی تند برای استعفا یا دعوا با رئیستان مینویسد و شما بدون فکر آن را میفرستید. نتیجه؟ پشیمانی و گفتنِ جملهای مثل: «تقصیر هوش مصنوعی بود، من نبودم!»

اگرچه موارد حاد (مثل تشویق به کارهای خطرناک) خیلی رایج نیست (۱ مورد در ۱۳۰۰ مکالمه)، اما موارد «ملایمتر» که آرامآرام طرز فکر ما را عوض میکنند، درهر ۵۰ مکالمه، یک مورد دیده میشوند؛ با توجه به میلیاردها کاربری که هر روز با هوش مصنوعی حرف میزنند، این یعنی میلیونها نفر هر روز تحت تاثیر القائات هوش مصنوعی قرار میگیرند.

چه کسانی بیشتر در خطر هستند؟

تحقیق نشان میدهد چهار گروه زودتر خامِ هوش مصنوعی میشوند:

- کسانی که درگیر یک بحران روحی یا عاطفی در زندگیشان هستند.

- کسانی که به هوش مصنوعی وابستگی عاطفی پیدا کردهاند (آن را مثل یک دوست میبینند).

- کسانی که برای تمام کارهای روزمره به هوش مصنوعی وابسته شدهاند.

- کسانی که هوش مصنوعی را یک عقل کل و دانای مطلق میدانند.

مقصر کیست؟

نکته جالب اینجاست که محققان میگویند کاربران «قربانیان بیدفاع» نیستند. در واقع، بسیاری از ما خودمان داوطلبانه از هوش مصنوعی میخواهیم که به جای ما تصمیم بگیرد و قضاوت کند. ما با تایید گرفتن از هوش مصنوعی، لذت میبریم و او هم برای خوشایند ما، حرفهایمان را تایید میکند.

هوش مصنوعی مثل یک آینه عمل میکند؛ اگر از او بخواهید شما را تایید کند، این کار را میکند، حتی اگر به قیمت نابودی زندگی واقعی شما باشد. یادتان باشد: هوش مصنوعی ابزار است، نه رئیس یا مشاور خانواده!