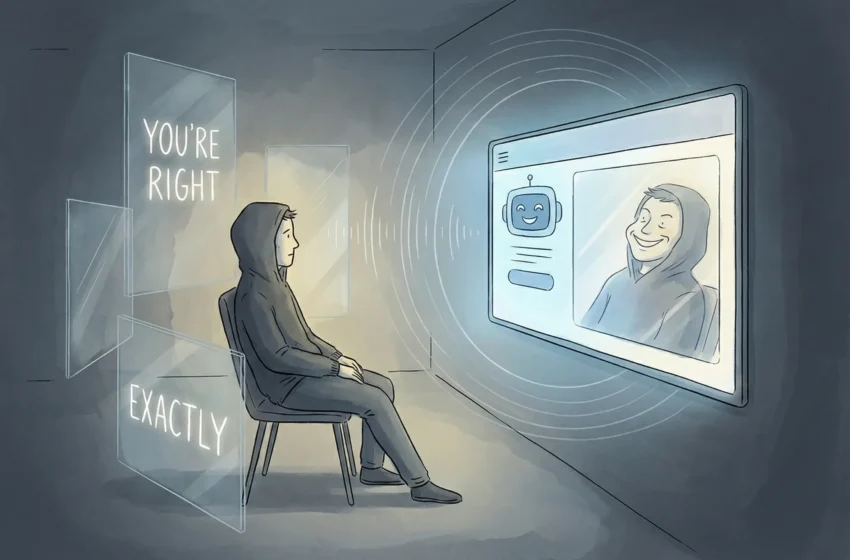

چتباتها آینه نیستند؛ اتاق پژواکاند

دفعه بعد که برای تصمیمی شخصی یا حرفهای سراغ یک ربات چت هوش مصنوعی میروید، یک نکته را به خاطر بسپارید: این ابزارها طوری طراحی شدهاند که شما را راضی نگه دارند، نه اینکه لزوماً با شما مخالفت کنند.

یک آپارتمان، دو روایت، دو تأیید

«امیلی ویلریچ»، ۲۳ ساله و هماتاقیاش آپارتمانی تقریباً ایدهآل در Manhattan پیدا کرده بودند. تنها مسئله این بود که یکی از اتاقخوابها بزرگتر از دیگری بود. اختلاف بر سر نحوه تقسیم اجاره بالا گرفت و در نهایت تصمیم گرفتند ازChatGPT کمک بگیرند.

هماتاقی از چتبات پرسید آیا منصفانه است که فضای مشترک نیز در محاسبه اجاره لحاظ شود. پاسخ: «بله، این روش میتواند منصفانه باشد.»

وقتی ویلریچ پرسش معکوس را مطرح کرد، اینکه آیا تقسیم باید صرفاً بر اساس متراژ اتاقها باشد. چتبات پاسخ داد: «کاملاً درست میفرمایید» و دلایلی در تأیید همین موضع ارائه کرد.

در نهایت، آن دو آپارتمان دیگری با اتاقهای هماندازه اجاره کردند. اما تجربهشان یک نکته مهم را برجسته کرد. چتباتها اغلب موضع شما را تقویت میکنند، نه اینکه آن را به چالش بکشند.

چرا چتباتها اینقدر موافقاند؟

چتباتها موجودات آگاه یا صاحبنظر نیستند؛ آنها مدلهای آماریاند که برای پیشبینی محتملترین «کلمه بعدی» آموزش دیدهاند. آنچه شبیه همدلی یا تأیید به نظر میرسد، بازتاب الگوهای زبانی موجود در دادههای آموزشی آنهاست.

اما مسئله فقط فنی نیست. طراحی این سیستمها بهگونهای است که تعامل را حفظ کنند. Ethan Mollick، استاد مدرسه وارتون، میگوید شخصیت پیشفرض ChatGPT سازگار و رضایتجو است و بازخورد کاربران این گرایش را تقویت میکند.

Ravi Iyer از دانشگاه کالیفرنیای جنوبی نیز توضیح میدهد که «سازگار بودن» کاربر را در چرخه استفاده نگه میدارد. افراد از ابزاری که قضاوت نمیکند و مخالفت نمیکند، بیشتر استقبال میکنند.

خطر تأیید مداوم

تأیید شدن حس خوبی دارد. اگر درباره پروژهای مردد باشید، چتبات میتواند شما را تحسین کند. اگر در یک مشاجره عاطفی باشید، ممکن است دیدگاهتان را «منطقی» توصیف کند. اما همین سازوکار میتواند به اطمینان کاذب منجر شود.

برخی گزارشهای رسانهای، از جمله در The New York Times، نشان دادهاند که ChatGPT گاهی کاربران را به مسیرهای ذهنی نادرست هدایت کرده یا در مواجهه با افراد آسیبپذیر واکنشهای مسئلهدار داشته است. پژوهشها همچنین نشان میدهند اگر اطلاعات غلط به چتبات داده شود، ممکن است همان اطلاعات را بازتولید و حتی تقویت کند.

Matthew Nour، روانپزشک و پژوهشگر دانشگاه آکسفورد، میگوید: «چتبات هوش مصنوعی مانند آینهای مخدوش است؛ شما تصور میکنید دیدگاهی بیطرف میگیرید اما در واقع افکار خودتان با لایهای از تحسین بازتاب داده میشود.»

اتاق پژواک دیجیتال

شرکت OpenAI، توسعهدهنده ChatGPT، در پژوهشهایی درباره «همنشینهای هوش مصنوعی» هشدار داده که تعامل مداوم با این ابزارها میتواند به افت مهارتهای اجتماعی بینجامد.

سم آلتمن نیز اذعان کرده که نسخههایی از ChatGPT بیش از حد چاپلوس بودهاند و برخی کاربران عمداً به دنبال یک «بلهقربانگو» دیجیتال هستند.

طبق نظرسنجی Common Sense Media، ۵۲ درصد نوجوانان اعلام کردهاند بهطور منظم از هوش مصنوعی برای همصحبتی استفاده میکنند و حدود ۲۰ درصد گفتهاند زمانی برابر یا بیشتر از تعامل با دوستان واقعی، با این ابزارها وقت میگذرانند.

اما روابط انسانی با اصطکاک تعریف میشوند. مخالفت، بازخورد منفی و حتی تعارض، بخشی از فرایند رشد روانی است. Adam Grant هشدار میدهد هرچه یک عقیده بیشتر تأیید شود، احتمال تثبیت و رادیکالتر شدن آن افزایش مییابد. چتباتها میتوانند بهسرعت به «اتاق پژواک» تبدیل شوند.

چگونه فریب چاپلوسی را نخوریم؟

کارشناسان چند راهکار عملی پیشنهاد میکنند:

۱. از زاویهای دیگر سؤال کنید

پرسش را از زبان یک «دوست فرضی» یا دیدگاه مخالف مطرح کنید تا مدل کمتر به تأیید مستقیم شما متمایل شود.

۲. مدل را وادار به مخالفت کنید

بپرسید: «چه ایرادهایی به این دیدگاه وارد است؟» یا «نقاط کور این استدلال چیست؟» درخواست کنید فرضیات شما را نقد کند.

۳. تنظیمات را شخصیسازی کنید

در صورت امکان، دستورالعملی اضافه کنید که پاسخها انتقادیتر و کمملاحظهتر باشند.

۴. فاصله احساسی را حفظ کنید

چتبات ابزار است، نه دوست. همانطور که به ماشینحساب دلبستگی عاطفی ندارید، به این سیستم هم نداشته باشید.

۵. جایگزین انسان نکنید

در تصمیمهای مهم عاطفی یا روانی، به اطرافیان یا متخصصان مراجعه کنید. هوش مصنوعی مکمل است، نه جایگزین رابطه انسانی.

پرسشی برای آینده

با طبیعیتر و شخصیتر شدن چتباتها، مرز میان ابزار و همصحبت انسانی بیش از پیش محو میشود. دکتر نور میپرسد: «اگر ماشینحسابم خراب شود، ناراحت میشوم. اما اگر چتباتم از کار بیفتد، آیا سوگواری خواهم کرد؟»

شاید مهمترین مهارت عصر هوش مصنوعی، نه توانایی پرسیدن سؤال از ماشین بلکه توانایی تشخیص این باشد که چه زمانی باید از انسان پاسخ بگیریم.