استانداردهای اخلاقی هوش مصنوعی و نقش تعیینکننده بریتانیا در آنها

یافتههای «جامعه کامپیوتر بریتانیا» یا به اختصار «BCS» نشان میدهد که انگلیس سطح استانداردهای اخلاقی هوش مصنوعی را بالا برده است. شرکتهای نامآوازهای از قبیل «DeepMind» ،«Graphcore» ،«Oxbotica» ،«Darktrace» و «BenevolentAI» در انگلیس قرار دارند و این کشور را به رهبر هوش مصنوعی اروپا تبدیل کردهاند. البته این کشور در حمایت و تامین منابع مالی این شرکتها با چالشهای بسیاری روبرو است و عملاً یارای رقابت با کشورهای چین و آمریکا را ندارد.

به باور بسیاری از کارشناسان، انگلیس باید به فکر تقویت ارزشهای دموکراتیک خود باشد و دانشگاهها، موسسهها و دموکراسی را در صدر اولویتهایش قرار دهد تا به یکی از سردمداران بزرگ هوش مصنوعی جهان تبدیل شود. تنها در این صورت است که میتوان به نقش مفید فناوریهای هوش مصنوعی در خدمترسانی به بشر امیدوار بود.

دکتر «بیل میشل» – مدیر سیاستگذاری در جامعه کامپیوتر بریتانیا و نگارندهای اصلی گزارش حاضر – اظهار داشت: «انگلیس باید استانداردهای اخلاقی هوش مصنوعی و همچنین حرفهای خود را ارتقاء بخشد چرا که این امر میتواند به احیای اقتصادی آن نیز کمک کند. همه باید به کارکردهای هوش مصنوعی ایمان داشته باشیم چرا که این فناوری در سالهای آتی زندگی بشر را به شدت تحت تاثیر قرار خواهد داد.

در این راستا، میتوان از قابلیتهای زنان و مردانی کمک گرفت که در حرفههای گوناگونی سررشته دارند و میتوانند نرمافزارهایی را با توجه به نیاز افراد توسعه دهند. از جمله این نرمافزارها میتوان به نرمافزارهای تشخیص سرطان بر اساس دادههای آموزشی، اعتبارسنجی و امکان حضور در جلسه مصاحبه اشاره کرد.»

سوگیری سیستمهای هوش مصنوعی

در حال حاضر، بسیاری از سیستمهای هوش مصنوعی دچار سوگیری هستند؛ این عامل میتواند مشکلات اجتماعی موجود را تشدید کند. این مشکلات شامل شکاف ثروت، تبعیض نژادی، جنسیتی، سنی و غیره میباشد. میشل در ادامه این چنین توضیح میدهد: «باید نیروی کار متخصص، اخلاقمدار و متنوعی در اختیار داشته باشیم که درک خوبی از هوش مصنوعی داشته باشد تا راهحلهای مناسبی برای مشکلات جامعه ارائه کنند. تحقق این هدف به رهبری قدرتمند و همت بالای دولت بستگی دارد. افزون بر این، باید نیروهای متخصص در حوزه فناوریهای دیجیتال به خدمت گرفته شوند.»

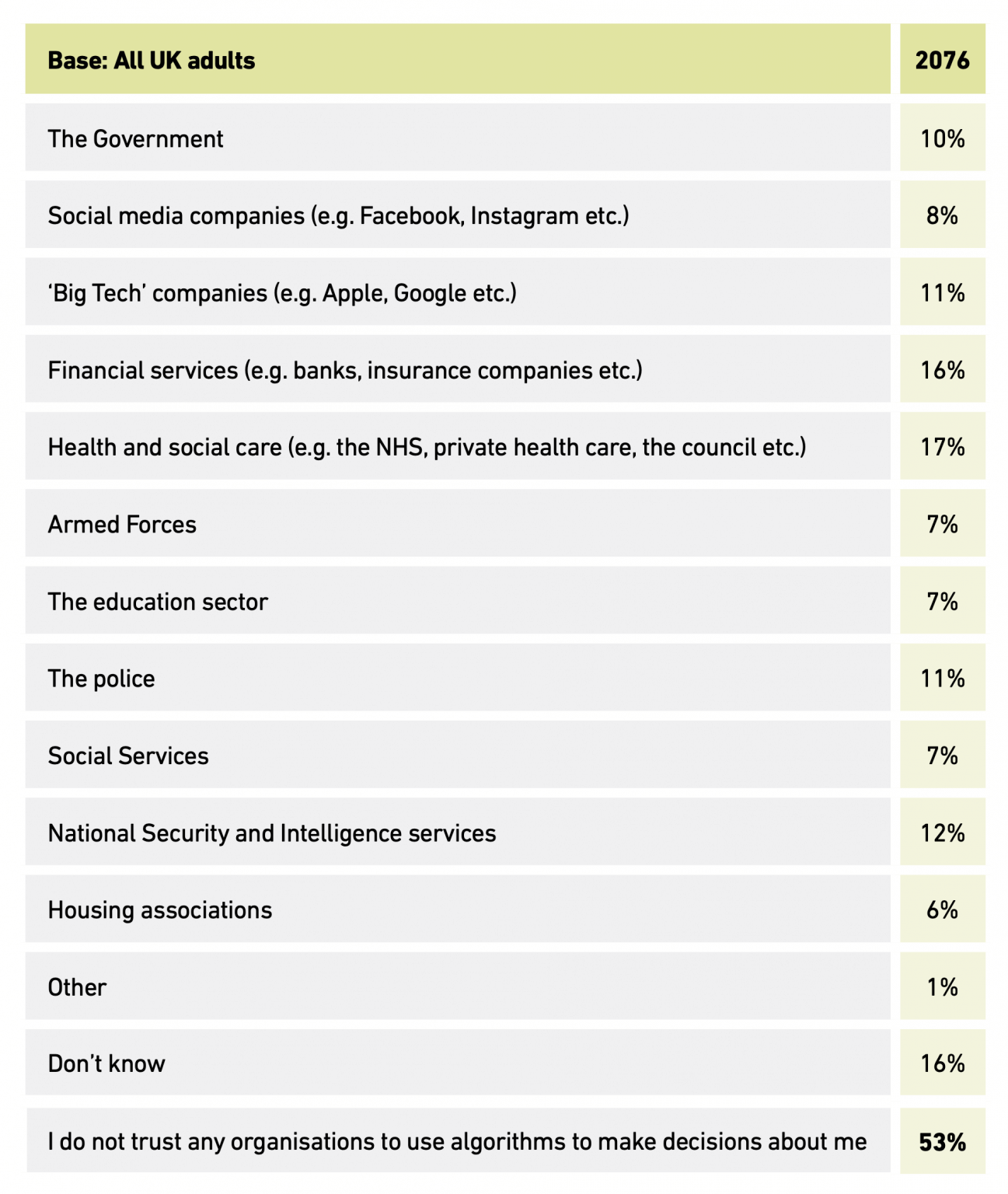

هوش مصنوعی در میان عموم مردم چندان مورد اعتماد قرار ندارد. تابستان سال گذشته از الگوریتمی برای تخمین نمرات دانشآموزان استفاده شد. بر اساس نتایج نظرسنجی موسسه «YouGov»، 53% از مردم بزرگسال انگلیس به قضاوتهای هیچ سازمانی درباره آنها اعتماد نداشتند. در سال گذشته، رسانههای داخلی اعلام کردند: «کدهایی که پروفسور نایل فرگوسن و همکارانش در امپریال کالج لندن نوشتند، باعث شد تا اعتماد عموم مردم به نرمافزارها خدشهدار گردد. از آن زمان به بعد، مجله معتبر نیچر تایید کرده که کد کامپیوتری پروفسور فرگوسن برای اهداف تعیینشده مناسب است. اما بسیاری از مردم این مقالههای نیچر را مطالعه نکردهاند و کماکان بر این باورند که این کد اشتباه است.»

در این گزارش، سازمانهایی که از هوش مصنوعی استفاده میکردند، نابرابری چشمگیری به لحاظ توانش و اقدامات اخلاقی داشتند. نویسندگان گزارش به دولت پیشنهاد دادهاند که استانداردهایی برای پذیرش هوش مصنوعی در بخشهای دولتی و خصوصی در نظر گیرد. در راهبرد ملی دادههای دولت انگلیس این چنین آمده است: «اگر داده ها به شکل غیرصحیح به کار برده شود، میتواند به مردم یا جامعه آسیب بزند. اگر مردم اعتمادشان را در این مورد از دست دهند، امکان بهرهبرداری از کلیه ظرفیتهای آن وجود نخواهد داشت.»

جدیدترین اخبار هوش مصنوعی ایران و جهان را با هوشیو دنبال کنید