هشت مدل زبانی بزرگ بازمتن برتر برای سال ۲۰۲۴

انقلاب کنونی در حوزه هوش مصنوعی مولد، بدون مدلهای زبانی بزرگ (LLM) امکانپذیر نبود. LLMها، مبتنی بر ترانسفورمرها، معماری عصبی قدرتمند، سیستمهای هوش مصنوعی هستند که برای مدلسازی و پردازش زبان انسان استفاده میشوند. آنها به دلیل داشتن صدها میلیون یا حتی میلیاردها پارامتر که با استفاده از مجموعهای عظیم از دادۀ متنی پیشآمدهاند، «مدلهای زبانی بزرگ» یا LLM نامیده میشوند.

مدلهای اختصاصی در برابر بازمتن

مدلهای زبانی بزرگ (LLM) به عنوان پایه و اساس Chatbot محبوب و پرکاربردی مانند ChatGPT و Google Gemini به شمار میآیند. به طور خاص، ChatGPT بر پایه GPT-4، یک LLM پیشرفته تولید شده و متعلق به OpenAI، توسعهیافته است، در حالی که Google Bard مبتنی بر مدل PaLM2 است که توسط گوگل طراحی و توسعهیافته است.

ChatGPT و Bard، و نیز بسیاری از چتباتهای محبوب دیگر، یک ویژگی مشترکی دارند که به اختصاصیبودن LLM پایه آنها برمیگردد. به عبارتی، این مدلها متعلق به یک شرکت خاص هستند و تنها مشتریان میتوانند پس از خرید مجوز، از آنها بهرهمند شوند. این مجوز مختص حقوق قانونی است، اما در عین حال شامل محدودیتهایی در نحوه استفاده از LLM و اطلاعات اندکی درباره مکانیزمهای نهفته در فناوری نیز میباشند.

بااینحال، همزمان با این تحولات، جنبشی موازی در عرصه LLMها در حال رشد و شکوفایی است. مدلهای زبانی بزرگ (LLM) بازمتن؛ در پی نگرانیهای فزاینده از فقدان شفافیت و دسترسی محدود به LLMهای اختصاصی که عمدتاً تحت کنترل شرکتهای بزرگ فناوری مانند مایکروسافت، گوگل و اوپنایآی (OpenAi) قرار دارند، LLMهای بازمتن نوید میدهند که میتوانند زمینه گسترش LLMها و هوش مصنوعی مولد را به ارتقایی قابلدسترستر، شفافتر و نوآورتر رهنمون سازند.

هرچند مدت زیادی از راهاندازی ChatGPT و جلب توجه LLMهای اختصاصی میگذرد، جامعه بازمتن پیشتر به دستاوردهای مهمی نائل آمده و اکنون شاهد تنوع چشمگیری از LLMهای بازمتن هستیم که برای اهداف مختلف در دسترس قرار دارند. استفاده از LLMهای بازمتن به جای LLMهای اختصاصی مزایای متعددی در کوتاهمدت و بلندمدت دارند. که برخی از مهمترین آنها به شرح زیر است:

مزایای استفاده از LLMهای بازمتن

- امنیت و حریم خصوصی دادههای بهبودیافته

یکی از بزرگترین نگرانیهای استفاده ازLLMهای اختصاصی، خطر نشت اطلاعات یا دسترسی غیرمجاز به دادههای حساس توسط ارائهدهندگان این مدلهاست. در واقع، پیشتر چندین مورد جنجالی در خصوص استفاده ادعایی از دادههای شخصی و محرمانه به منظور آموزش این مدلها مطرح شده است. تصور کنید شما یا سازمانی که برای آن کار میکنید اسناد مالی یا حقوقی خود را در اختیار مدلی مانند Chatgpt قرار دهید. اما امنیت این اطلاعات واقعاً محفوظ خواهد بود؟ اما با بهرهگیری از LLMهای بازمتن، مدیریت و کنترل کامل بر اطلاعات خود را در اختیار خواهید داشت.

- صرفهجویی در هزینه و کاهش وابستگی به فروشنده

اکثر LLMهای اختصاصی برای استفاده به مجوز نیاز دارند که در بلندمدت میتواند به هزینهای سنگین تبدیل شود؛ هزینهای که شرکتها، بهویژه شرکتهای کوچک و متوسط، ممکن است از عهده پرداخت آن برنیایند. این معضل در خصوص LLMهای بازمتن صدق نمیکند، زیرا اغلب استفاده از آنها به صورت رایگان امکانپذیر است.

بااینحال، لازم به یادآوری است که اجرایLLM ها، حتی برای فرایند استنتاج، به منابع قابلتوجهی نیاز دارد. در نتیجه، معمولاً باید هزینههای مربوط به استفاده از خدمات ابری یا زیرساختهای قدرتمند را نیز در نظر گرفت.

- شفافیت کد و امکان سفارشیسازی مدل زبان

شرکتهایی کهLLMهای بازمتن را به عنوان گزینه انتخابی خود مورداستفاده قرار میدهند، به تمامی جوانب عملکرد این مدلها، از جمله کد منبع، معماری، دادههای آموزشی و مکانیسمهای آموزش و استنتاج، دسترسی خواهند داشت. این شفافیت، نخستین قدم در جهت بررسی دقیق و همچنین امکان سفارشیسازی مدل است.

از آنجا که LLMهای بازمتن بهطور کلی در دسترس هستند و شامل کد منبع خود میشوند، شرکتها میتوانند این مدلها را مطابق با نیازهای خاص خود بهطور شخصیسازیشده تنظیم کنند.

- حمایت فعال جامعه و تقویت نوآوری

جنبش بازمتن وعده میدهد که استفاده و دسترسی به LLM و فناوریهای هوش مصنوعی مولد را دموکراتیک کند. فراهمآوردن امکان بررسی عملکرد داخلی LLMها برای توسعهدهندگان، گامی اساسی در جهت پیشرفت این فناوری محسوب میشود. با کاهش موانع ورود برای برنامهنویسان در سرتاسر جهان، LLMهای بازمتن میتوانند نوآوری را تقویت کرده و از طریق کاهش تعصبات و افزایش دقت و کارایی کلی، مدلها را به نحو چشمگیری بهبود بخشند.

- کاهش اثرات محیط زیستی هوش مصنوعی

با توجه به افزایش محبوبیت LLMها، محققان و ناظران محیطزیست نگرانیهای خود را در خصوص ردپای کربن و مصرف آب لازم برای پیادهسازی این فناوریها ابراز کردهاند. LLMهای اختصاصی به ندرت اطلاعات دقیقی درباره منابع موردنیاز برای آموزش و بهرهبرداری یا ردپای زیستمحیطی مرتبط منتشر میکنند.

اما با ظهور LLMهای بازمتن، محققان این فرصت را دارند که به اطلاعات موردنیاز دسترسی پیدا کنند؛ اطلاعاتی که میتواند نقشی حیاتی در طراحی بهبودهای جدید برای کاهش اثرات زیستمحیطی هوش مصنوعی ایفا کند.

هشت مدل زبانی بزرگ بازمتن برتر سال ۲۰۲۴

1. LLaMA 3.1

اکثر بازیگران پیشرو در عرصه LLM ترجیح دادهاند که مدلهای خود را در پس درهای بسته توسعه دهند. با این حال، متا با مجموعه LLMهای بازمتن خود که بهتازگی شامل LLaMA 3.1 شده، همچنان بهعنوان یک استثنا در این فضا به شمار میآید.

LLaMA 3.1 که در تاریخ 23 ژوئیه 2024 روانه بازار شد، شامل مدلهایی با پارامترهای B8، B70 و برای نخستین بار، B405 است که آن را به بزرگترین مدل در این سری تبدیل میکند. این مدلها بهمنظور انجام طیف وسیعی از وظایف پردازش زبان طبیعی در زبانهای مختلفی از جمله انگلیسی، اسپانیایی، پرتغالی، آلمانی، تایلندی، فرانسوی، ایتالیایی و هندی طراحی شدهاند.

مدلهای LLaMA 3.1 به لطف پشتیبانی از طول زمینهای بسیار گسترده با حداکثر 128,000 توکن، توانایی خود را در پردازش و درک متون طولانی بهطرز چشمگیری افزایش دادهاند. این ویژگی نه تنها عملکرد آنها را در وظایف استدلال پیچیده بهبود میبخشد، بلکه در حفظ زمینه در مکالمات طولانی نیز تاثیر بسزایی دارد.

مدل B405 بهویژه بهعنوان یک نیروگاه تولید دادههای مصنوعی شناخته میشود که میتواند بهعنوان منبعی ارزشمند برای آموزش مدلهای دیگر و تقطیر دانش مورداستفاده قرار گیرد. به این ترتیب، دانش حاصل از این مدل عظیم قادر است به مدلهای کوچکتر و کارآمدتر منتقل شود. این قابلیت، امکانات بینظیری را برای استقرار هوش مصنوعی پیشرفته در محیطهای با منابع محدود فراهم میآورد.

علاوه بر این، LLaMA 3.1 همچنان از یادگیری تقویتی بر اساس بازخورد انسانی (RLHF) بهره میبرد تا اطمینان حاصل کند که مدلها با ترجیحات انسانی در زمینه مفیدبودن و ایمنی همخوانی دارند.

2. BLOOM

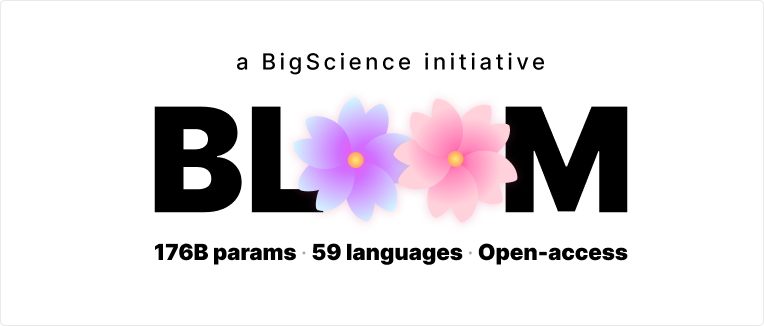

BLOOM که در سال 2022 و پس از یک پروژه همکاری یکساله با داوطلبانی از بیش از 70 کشور و محققان Hugging Face منتشر شد، نوعی مدل زبانی خود رگرسیو (LLM) است. این مدل برای ادامه متن را براساس یک درخواست خاص، بر روی مجموعههای عظیم و گستردهای از دادههای متنی آموزشدیده و با بهرهگیری از منابع محاسباتی مقیاس صنعتی توسعهیافته است.

انتشار BLOOM بهعنوان یک نقطه عطف مهم در مسیر دموکراتیک کردن هوش مصنوعی مولد تلقی میشود. این مدل، با برخورداری از 176 میلیارد پارامتر، یکی از قدرتمندترین مدلهای زبانی بازمتن به شمار میرود و توانایی ارائه متنهای منسجم و دقیقی به 46 زبان و 13 زبان برنامهنویسی را داراست.

شفافیت اساس پروژه BLOOM است. این پروژه بهگونهای طراحی شده که همه افراد بتوانند به کد منبع و دادههای آموزشی دسترسی پیدا کنند تا بتوانند آن را اجرا کرده، موردمطالعه قرار داده و بهبود بخشید.

میتوان به صورت رایگان از BLOOM از طریق اکوسیستم Hugging Face استفاده کنید.

3. BERT

تکنولوژی مبنایی LLM از نوع یک معماری عصبی به نام ترانسفورمر است. این معماری توسط محققان گوگل در سال 2017 در مقاله Attention is All You Need معرفی شد. یکی از اولین آزمایشهای انجام شده بر روی ترانسفورمرها BERT بود.

BERT (Bidirectional Encoder Representations from Transformers) که توسط گوگل در سال 2018 به عنوان یک LLM (زبان طبیعی تفسیر شده توسط رایانه) معرفی شد، به سرعت به عملکرد پیشرفتهای در بسیاری از وظایف پردازش زبان طبیعی دست یافت.

به لطف ویژگیهای نوآورانه این مدل، در اوایل LLMها و به دلیل بازمتن بودن، BERT به یکی از محبوبترین و پرکاربردترین LLMها تبدیل شد. به عنوان مثال، در سال 2020، گوگل اعلام کرد که از BERT در بیش از 70 زبان در Google Search استفاده میکند.

در حال حاضر هزاران مدل BERT بازمتن، رایگان و آماده برای استفاده در موارد خاص مانند تحلیل احساسات، تحلیل یادداشتهای بالینی و تشخیص نظر سمی وجود دارد.

4. Falcon 180B

اگر Falcon 40B پیشتر تأثیراتی را بر جامعه منابع زبان و بازمتن داشته باشد (که این مدل بهعنوان ردهبند اصلی در جدول امتیازدهی Hugging Face برای مدلهای زبانی بزرگ بازمتن معرفی شده است)، آنگاه نمونه جدید Falcon 180B نشان میدهد که فاصله بین منابع زبان خصوصی و منابع زبان بازمتن به سرعت در حال کاهشیافتن است.

Falcon 180B که در سپتامبر 2023 توسط موسسه نوآوری فناوری امارات متحده عربی منتشر شد، در حال آموزش با 180 میلیارد پارامتر و 3.5 تریلیون توکن است. با این توان محاسباتی چشمگیر، Falcon 180B هم اکنون در وظایف مختلف NLP از LLaMA 2 و GPT-3.5 پیشتاز است و Hugging Face پیشنهاد میدهد که میتواند با PaLM 2 از گوگل، LLM که Google Bard را تقویت میکند، رقابت کند.

اگرچه Falcon 180B برای استفاده تجاری و تحقیقاتی رایگان در دسترس است، اما باید توجه داشت که برای عملکرد بهتر به منابع محاسباتی مهم نیاز دارد.

5. OPT-175B

منتشرشدن مدلهای زبان پیشآماده باز (OPT) ترانسفورمر در سال 2022، یک نقطه عطف مهم دیگر در استراتژی متا برای آزادسازی رقابت LLM از طریق بازمتن بود.

OPT شامل یک مجموعه از ترانسفورمرهای پیشآماده برای استفاده تنها به عنوان رمزگشا است که دارای 125M تا 175B پارامتر است. OPT-175B یکی از پیشرفتهترین LLMهای بازمتن در بازار است و قدرتمندترین نسل از این محصول با عملکرد مشابه GPT-3 است. هر دو مدل پیشآماده و کد منبع آنها برای عموم در دسترس قرار دارند.

با این حال، اگر در حال تصورکردن ایجاد یک شرکت مبتنی بر هوش مصنوعی با LLM هستید، بهتر است به چیز دیگری فکر کنید، زیرا OPT-175B تحت یک مجوز غیرتجاری منتشر میشود که تنها استفاده از مدل برای موارد تحقیقاتی را مجاز میکند.

6. XGen-7B

شرکتهای بیشتری در حال ورود به رقابت LLM هستند. یکی از شرکتهای تازه وارد به این رقابت، Salesforce است که LLM XGen-7B خود را در ماه ژوئیه 2023 معرفی کرده است.

به گفته نویسندگان، بیشتر LLMهای بازمتن به تولید پاسخهای طولانی با دسترسی محدود (درخواستهای کوتاه با اطلاعات محدود) متمرکز هستند. هدف اصلی از XGen-7B ایجاد ابزاری است که از پنجرههای زمانی طولانیتر پشتیبانی کند. بهطور خاص، نسل پیشرفتهتر XGen (XGen-7B-8K-base) قادر است به پنجره زمانی K8، یعنی اندازه تجمعی متن ورودی و خروجی، پاسخ دهد.

کارایی تنها یکی از اولویتهای اصلی XGen نیست. این سیستم فقط از B7 پارامتر برای آموزش استفاده میکند که مقدار آن بسیار کمتر از LLMهای بازمتن قدرتمند مانند LLaMA 2 یا Falcon است.

با وجود اندازه نسبتاً کوچک خود، XGen همچنان میتواند نتایج عالی ارائه دهد. این مدل برای اهداف تجاری و تحقیقاتی در دسترس است، به جز نوع XGen-7B- {4K,8K} -inst که بر روی دادههای آموزشی و RLHF آموزشدیده است و تحت یک مجوز غیرتجاری منتشر میشود.

7. GPT-NeoX و GPT-J

GPT-NeoX و GPT-J توسط محققان آزمایشگاه تحقیقاتی غیرانتفاعی هوش مصنوعی EleutherAI توسعه یافتهاند و به عنوان دو جایگزین عالی و بازمتن برای GPT شناخته میشوند.

GPT-NeoX دارای بیست میلیارد پارامتر است، در حالی که GPT-J دارای شش میلیارد پارامتر است. اگرچه پیشرفتهترین LLMها میتوانند با بیش از صد میلیارد پارامتر آموزش داده شوند، این دو LLM همچنان میتوانند نتایج با دقت بالا ارائه دهند.

آنها با 22 مجموعه داده باکیفیت از یک مجموعه متنوع از منابع آموزشدیده شدهاند که قابل استفاده در چندین حوزه و بسیاری از موارد میباشد. برخلاف GPT-3، GPT-NeoX و GPT-J با RLHF آموزش داده نگرفتهاند.

همه کارهای پردازش زبان طبیعی میتواند با استفاده از GPT-NeoX و GPT-J انجام شود؛ از تولید متن و تحلیل احساسات گرفته تا توسعه تحقیقات و کمپینهای بازاریابی.

هر دو تکنولوژی از طریق API NLP Cloud به صورت رایگان در دسترس قرار دارند.

8. Vicuna 13-B

Vicuna-13B یک مدل گفتگوی بازمتن است که از تنظیم دقیق مدل LLaMa 13B با استفاده از مکالمات جمعآوری شده توسط کاربر از ShareGPT آموزشدیده است.

به عنوان یک هوش مصنوعی پیشرفته، Vicuna-13B کاربردهای گوناگونی دارد که از جمله آنها میتوان به خدمات مشتری، مراقبتهای بهداشتی، آموزش، امور مالی و سفر/مهماننوازی در صنایع مختلف اشاره کرد.

ارزیابی اولیه با استفاده از GPT-4 نشان داد که Vicuna-13B بیش از ۹۰٪ کیفیت ChatGPT و Google Bard را دارد و در بیش از ۹۰٪ موارد از مدلهای دیگر مانند LLaMa و Alpaca بهتر عمل کرده است.

انتخاب LLM بازمتن متناسب با نیازهای بشر

فضای LLM بازمتن در حال گسترش سریعی است. امروزه تعداد زیادی از LLMهای بازمتن وجود دارند که بسیار بیشتر از LLMهای اختصاصی هستند. این موضوع ممکن است منجر به پر شدن شکاف عملکرد بشود، زیرا توسعهدهندگان در سراسر جهان به منظور بهبود LLMهای فعلی و طراحی بهتر LLMها به همکاری میپردازند.

انتخاب یک LLM بازمتن مناسب در این عرصه پویا و پرشور میتواند چالشبرانگیز باشد. عوامل متعددی وجود دارند که باید هنگام تصمیمگیری در مورد LLM منتخب در نظر بگیرید. برای کمک به شما در این فرایند، لیستی از معیارهای کلیدی تهیه شده و در ادامه آورده شده است:

میخواهید چه کاری انجام دهید؟

هنگام تصمیمگیری در مورداستفاده از یک LLM بازمتن، اولین سؤالی که باید از خودتان بپرسید این است که آیا میخواهید یک کسبوکار راه بیندازید یا خیر. در حالی که LLMهای بازمتن همیشه در دسترس هستند، برخی از آنها فقط برای اهداف تحقیقاتی منتشر میشوند و ممکن است محدودیتهای مجوز داشته باشند. از خودتان بپرسید که آیا میخواهید یک شرکت راهاندازی کنید، زیرا این امر میتواند در انتخاب LLM مناسب شما تأثیرگذار باشد.

چرا به یک LLM نیاز دارید؟

مد بودن LLMها غیرقابلانکار است و هیجان زیادی در مورد تواناییهای آنها وجود دارد. با این حال، قبل از شیرجهزدن در استفاده از آنها، ارزش آن را دارد که یک قدم عقب برداریم و بپرسیم: آیا واقعاً به آنها نیاز داریم؟ اگر میتوانید پروژه خود را بدون آنها انجام دهید، ممکن است بهتر باشد از آنها اجتناب کنید. این نه تنها میتواند هزینهها را کاهش دهد، بلکه به معنای استفاده بهینه از منابع نیز هست.

به چه میزان دقت نیاز دارید؟

این موضوع از اهمیت بالایی برخوردار است. بین اندازه و دقت مدلهای زبانی بزرگ (LLM) پیشرفته، رابطهای مستقیم وجود دارد. به عبارت دیگر، به طور کلی هرچه تعداد پارامترها و دادههای آموزشی یک LLM بیشتر باشد، دقت آن نیز افزایش مییابد؛ بنابراین، در صورتی که بهدقت بالا نیاز دارید، باید به سراغ LLMهای بزرگتری مانند LLaMA یا Falcon بروید.

میخواهید چقدر سرمایهگذاری کنید؟

این موضوع ارتباط نزدیکی با سؤال قبلی دارد. هرچه مدل بزرگتر باشد، نیاز به منابع بیشتری برای آموزش و استفاده از آن وجود دارد. این به معنای نیاز به زیرساختهای اضافی برای بهرهبرداری یا هزینههای بالاتر از ارائهدهندگان خدمات ابری است، به ویژه اگر قصد دارید LLM خود را در فضای ابری اجرا کنید. LLMها ابزارهای بسیار قدرتمندی هستند، اما حتی برای استفاده از آنها، حتی LLMهای بازمتن، به منابع قابلتوجهی نیاز است.

آیا میتوانید با یک مدل پیشآماده به اهداف خود برسید؟

چرا باید وقت و انرژی خود را صرف آموزش LLM خود از ابتدا کنید، در حالی که میتوانید به راحتی از یک مدل پیشآماده بهره ببرید؟

در حال حاضر، نسخههای متعددی از LLMهای بازمتن وجود دارد که برای کاربردهای خاص آموزش دیدهاند. اگر ایده شما در یکی از این کاربردها قرار میگیرد، بهتر است از همان مدل استفاده کنید.

نتیجهگیری

مدلهای زبانی بازمتن در حال تجربه یک جنبش هیجانانگیز هستند. با پیشرفت سریع این مدلها، به نظر میرسد که حوزه هوش مصنوعی مولد به طور ضروری تحت تسلط بازیگران بزرگ که قادر به ساخت و استفاده از این ابزارهای قدرتمند هستند، نخواهد بود.