رازهای پشت پرده استدلال هوش مصنوعی

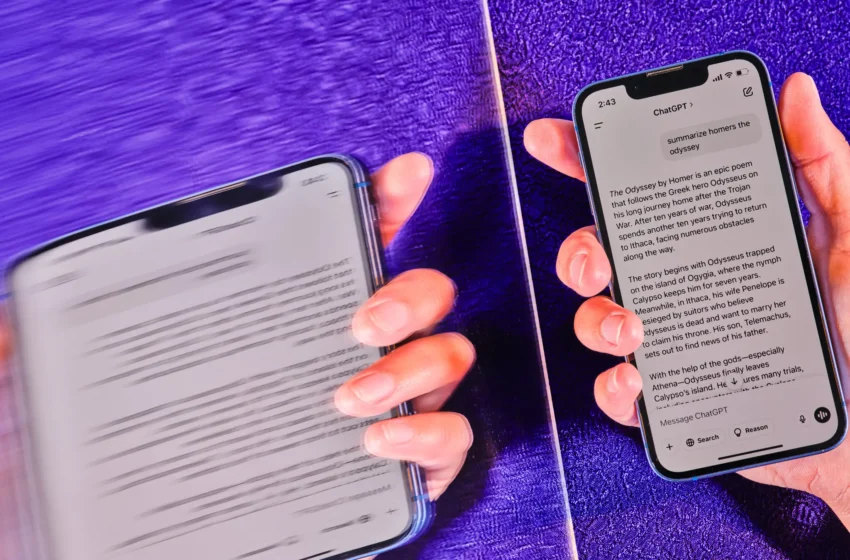

شرکت هوش مصنوعی نسل تازهای از چتباتها و مدلهای هوشمصنوعی را معرفی کردهاند که نهتنها برای گفتوگو، بلکه برای استدلال در حوزههایی مانند ریاضی، علوم و برنامهنویسی رایانهای طراحی شده اند. تفاوت اصلی این دست مدلها موسوم به استدلالی با نسخههای پیشین این بود که میتوانست برای حل مسائل پیچیده زمانی را صرف «تفکر» کند و سپس پاسخی نهایی ارائه دهند.

اما پرسشهای بنیادین در مورد این مدلها وجود دارد: آیا واقعاً هوش مصنوعی میتواند مانند انسان استدلال کند؟ «تفکر» در دنیای رایانه چه معنایی دارد؟ و آیا این مسیر ما را به سوی نوعی هوش واقعی هدایت خواهد کرد؟ در ادامه با ما همراه باشید تا با این سوالات پاسخ دهیم.

استدلال در یک سیستم هوش مصنوعی به چه معناست؟

استدلال صرفاً به این معناست که چتبات زمانی اضافی را برای کار روی یک مسئله صرف میکند. «دن کلاین»، استاد علوم رایانه در دانشگاه کالیفرنیا، برکلی و مدیر ارشد فناوری استارتآپ هوش مصنوعی Scaled Cognition میگوید: «استدلال زمانی است که سیستم پس از طرح پرسش، کار بیشتری انجام میدهد». این سیستم ممکن است مسئله را به مراحل جداگانه تقسیم یا تلاش کند از طریق آزمون و خطا به راهحل برسد. چتجیپیتی اولیه بلافاصله به پرسشها پاسخ میداد. اما سیستمهای استدلالی جدید میتوانند چند ثانیه یا حتی چند دقیقه روی یک مسئله کار کنند و سپس پاسخ دهند.

در برخی موارد، یک سیستم استدلالی رویکرد خود را نسبت به پرسشی اصلاح و بارها تلاش میکند روش انتخابشده را بهبود بخشد. گاهی نیز ممکن است چندین راه مختلف برای نزدیک شدن به یک مسئله امتحان و سپس یکی از آنها را انتخاب کند. یا حتی ممکن است به بررسی دوباره کاری که چند ثانیه قبل انجام داده برگردد، فقط برای اینکه مطمئن شود درست بوده است. در اصل، سیستم هر کاری را که بتواند انجام میدهد تا به پرسش شما پاسخ دهد. این شبیه دانشآموزی در مقطع ابتدایی است که در تلاش برای یافتن راهحل یک مسئله ریاضی، چندین گزینه مختلف را روی برگه مینویسد.

چه نوع پرسشهایی نیازمند استدلال در هوش مصنوعی هستند؟

در اصل، هوش مصنوعی میتواند درباره هر چیزی استدلال کند، اما استدلال زمانی بیشترین کارایی را دارد که پرسشها به ریاضی، علوم و برنامهنویسی رایانهای مربوط باشند.

در گذشته، شما میتوانستید از چتباتهای اولیه بخواهید نشان دهند چگونه به یک پاسخ رسیدهاند یا کار خود را بررسی کنند. از آنجا که نسخه اولیه چتجیپیتی از متونی در اینترنت آموزش دیده بود، جاهایی که افراد توضیح میدادند چگونه به پاسخی رسیدهاند یا کار خود را دوباره بررسی کردهاند، این مدل هم میتوانست چنین بازاندیشیهایی انجام دهد. اما یک سیستم استدلالی فراتر میرود. این سیستم میتواند چنین کارهایی را بدون درخواست کاربر انجام دهد و آنها را به شکل گستردهتر و پیچیدهتر پیش ببرد.

شرکتها آن را «سیستم استدلالی» مینامند، زیرا به نظر میرسد بیشتر شبیه فردی عمل میکند که در حال اندیشیدن روی یک مسئله دشوار است.

چرا استدلال هوش مصنوعی اکنون اهمیت دارد؟

شرکتهایی مانند OpenAI معتقدند این بهترین راه برای بهبود عملکرد چتباتهایشان است. سالها این شرکتها بر یک مفهوم ساده تکیه داشتند. هرچه دادههای اینترنتی بیشتری به چتباتها داده شود، عملکرد آنها بهتر خواهد شد. اما در سال ۲۰۲۴، تقریباً تمام متن موجود در اینترنت مصرف شد. این بدان معنا بود که آنها برای بهبود چتباتها به روش جدیدی نیاز داشتند، بنابراین شروع به ساخت سیستمهای استدلالی کردند.

چگونه یک سیستم استدلالی ساخته میشود؟

سال گذشته، شرکتهایی مانند OpenAI بهشدت به روشی موسوم به یادگیری تقویتی (Reinforcement Learning) تکیه کردند. در این فرایند که میتواند ماهها به طول بینجامد، یک سیستم هوش مصنوعی از طریق آزمون و خطاهای گسترده رفتارها را میآموزد. به عنوان مثال، با کار کردن روی هزاران مسئله ریاضی، میتواند یاد بگیرد کدام روشها به پاسخ درست منتهی میشوند و کدامها نمیشوند. پژوهشگران سازوکارهای بازخورد پیچیدهای طراحی کردهاند که به سیستم نشان میدهد چه زمانی درست عمل کرده و چه زمانی اشتباه.

«جری توورک»، پژوهشگر OpenAI میگوید: «این کمی شبیه تربیت یک سگ است. اگر سیستم درست عمل کند، به آن یک کلوچه میدهید. اگر درست عمل نکند، میگویید: “سگ بد!”»

آیا یادگیری تقویتی کارآمد است؟

یادگیری تقویتی در برخی حوزهها مانند ریاضی، علوم و برنامهنویسی رایانهای بهخوبی عمل میکند. این حوزهها جایی هستند که شرکتها میتوانند بهطور روشن رفتار درست و نادرست را تعریف کنند. مسائل ریاضی پاسخهای قطعی دارند. اما در حوزههایی مانند نوشتن خلاق، فلسفه و اخلاق، این روش چندان مؤثر نیست؛ زیرا تمایز میان درست و نادرست دشوارتر قابلتشخیص است. پژوهشگران میگویند این فرایند میتواند بهطور کلی عملکرد یک سامانه هوش مصنوعی را بهبود بخشد، حتی زمانی که به پرسشهایی خارج از ریاضیات و علوم پاسخ میدهد.

«جارد کاپلان»، مدیر ارشد علمی در Anthropic میگوید: «این فرایند بهتدریج میآموزد کدام الگوهای استدلال آن را به مسیر درست هدایت میکنند و کدامها نه».

آیا این سامانههای استدلالی هنوز خطا میکنند؟

قطعاً. هر کاری که یک چتبات انجام میدهد بر پایه احتمالات است. این سامانه مسیری را برمیگزیند که بیشترین شباهت را به دادههایی دارد که از آنها آموخته است، چه این دادهها از اینترنت آمده باشند یا از طریق یادگیری تقویتی تولید شده باشند. گاهی این سیستم گزینهای را انتخاب میکند که اشتباه است یا منطقی به نظر نمیرسد.

آیا این مسیر به سمت ماشینی همتراز با هوش انسانی است؟

کارشناسان هوش مصنوعی در این زمینه اختلافنظر دارند. این روشها هنوز نسبتاً جدید هستند و پژوهشگران همچنان در تلاشاند تا محدودیتهای آنها را بشناسند. در حوزه هوش مصنوعی، روشهای تازه معمولاً در ابتدا بسیار سریع پیشرفت میکنند، اما سپس روندشان کند میشود.