بررسی و مروری بر مزیتها و ریسکهای استفاده از عاملهای هوش مصنوعی بهعنوان یک فناوری نوپدید:

عاملهای هوش مصنوعی؛ خوب، بد، چالش

هوش مصنوعی در سالهای اخیر اثرات غیرقابلانکاری بر جنبههای مختلف زندگی جوامع انسانی گذاشته است بهگونهای شاید برای برخی روند عادی زندگی روزمره بدون استفاده از سامانههای هوش مصنوعی مختل شود. مانند هر نوع دیگری از فناوری مسیر توسعه حوزه هوش مصنوعی نیز به خودکارسازی و دخالت حداقلی انسان رسیده است. این مرز جدید هوش مصنوعی در قالب عاملهای هوش مصنوعی خودمختار (autonomous AI agents) شناخته میشود و به سامانههای هوشمندی که قادر به اخذ تصمیمات و انجام وظایف با نظارت حداقلی انسان هستند اطلاق میشود.

گذار از هوش سنتی به هوش خودمختار

عاملهای هوش مصنوعی خودمختار نماینده دوران گذار از سامانههای هوش مصنوعی سنتی که معمولاً به انسان برای هدایت نیاز دارند، به سامانههای مستقلتر و خودکفاتری هستند که میتوانند بهتنهایی بهعنوان یک عامل مستقل عمل کنند. در واقع عاملهای هوش مصنوعی از ابزارهای ساده فراتر رفته و به موجودات خودمختاری تبدیل میشوند که قادر به یادگیری، سازگاری و عملکرد با استقلال بیشتر هستند.

اما بااینحال، همانطور که عاملهای هوش مصنوعی توانمندتر میشوند، مجموعهای بینهایت از نگرانیها و دغدغههای جدید را نیز با خود به همراه میآورند. همانطور که این عاملها مسئولیت انجام وظایف پیچیدهتر از کارهای تکراری تا تصمیمگیری در محیطهای پرریسک را بر عهده میگیرند، نباید خطرات و چالشهایی که ممکن است ایجاد کنند را نادیده گرفت.

آیا میتوانیم به این سامانهها اعتماد کنیم که تصمیماتی متناسب با ارزشها و استانداردهای اخلاقی ما بگیرند؟

اگر یک عامل تصمیمی بگیرد که منجر به پیامدهای ناخواسته شود چه کسی پاسخگو خواهد بود؟

این نگرانیها با سرعت پیشرفت فناوری هوش مصنوعی پیچیدهتر و بنیادیتر نیز میشوند. باتوجهبه اینکه شرکتهای بزرگی همچون OpenAI، Meta و Google در حال رقابت برای توسعه سامانههای هوش مصنوعی پیچیدهتر هستند، اساسیترین سؤال این نیست که این سامانهها چه کارهایی میتوانند انجام دهند، بلکه این است که آیا جامعه آماده است تا به طور گسترده از آنها استفاده کند؟ آیا ما برای مواجهه با معضلات اخلاقی، مسائل مسئولیتپذیری و چالشهای امنیتی که با انتقال عاملهای هوش مصنوعی از کاربردهای خاص به استفاده عمومی ایجاد میشود، آمادهایم؟

عاملی برای بهرهوری

دانش هوش مصنوعی در سالهای اخیر پیشرفتهای عظیمی داشته است و از یک فناوری خاص به قدرتی تبدیل شده که توانایی بازتعریف صنایع و حتی زندگی روزمره را دارد. اما در قلب این تحول دیجیتال، عاملهای هوش مصنوعی قرار دارند؛ سامانههایی که برای عمل به طور خودمختار، اتخاذ تصمیمات و دستیابی به اهداف با حداقل مداخله انسانی طراحی شدهاند. این عاملها صرفاً یک سری ابزارهای ساده نیستند؛ آنها قادر به انجام وظایف پیچیده در زمینههای مختلف هستند که یک جهش روبهجلو نسبت به کاربردهای قبلی و محدودتری مانند چتباتها به شمار میآید. ظهور عاملهای هوش مصنوعی یک تغییر عمده در نحوه تعامل انسان با ماشین بهحساب میآید. برخلاف سامانههای سنتی هوش مصنوعی که نیاز به ورودی و نظارت مداوم انسان دارند، این عاملها بهگونهای طراحی شدهاند که به طور مستقل عمل کنند و وظایف را به نمایندگی از کاربر خود انجام دهند.

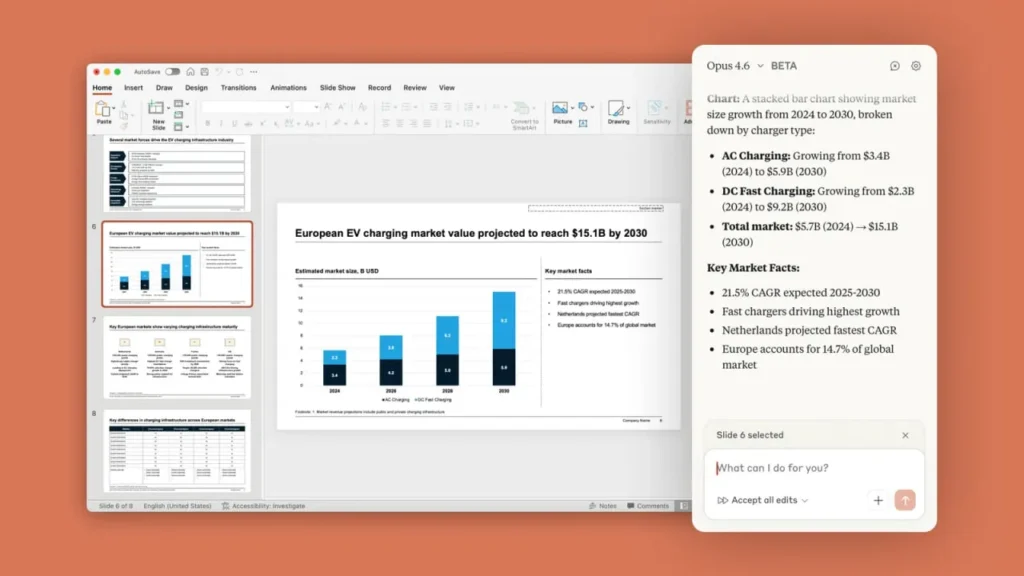

عاملهای هوش مصنوعی بر پایه مدلهای زبانی بزرگ، مشابه با چتباتها، ساخته شدهاند؛ اما آنها یک گام فراتر رفته و میتوانند با برنامههای خارج از محیط خود تعامل برقرار کرده، وظایف را انجام داده و بر اساس دادههای واقعی تصمیمگیری کنند. عاملهای هوش مصنوعی بهعنوان ابزارهایی انقلابی معرفی شدهاند که میتوانند نیروی انسانی را از بند انجام کارهای تکراری و کمارزش آزاد کنند و به آنها اجازه دهد بر روی کارهای اساسیتر و خلاقیتمحور تمرکز کنند. ازاینرو هدف نهایی این فناوری افزایش بهرهوری فعالیتهای انسانی است. بهعنوانمثال، یک شرکت ممکن است از عاملهای هوش مصنوعی برای پاسخگویی به درخواستهای خدمات مشتری، خودکارسازی فرایندهای روتین مانند ارسال گزارشهای هزینه یا مدیریت لجستیک زنجیره تأمین استفاده کند که به نیروی انسانی این امکان را میدهد تا وقت و انرژی خود را به تصمیمگیری راهبردی یا حل مسائل خلاقانه اختصاص دهد.

عاملی منحصربهفرد

اصطلاح عامل هوش مصنوعی اغلب گمراهکننده است، اما معنای آن بسته به زمینه کاربرد آن میتواند متفاوت باشد. عامل هوش مصنوعی سامانهای است که برای انجام وظایف به طور خودکار طراحی شده است بهطوری که با محیط خود سازگار شده و فرایندهای تصمیمگیری را برای دستیابی به اهداف خاص انجام میدهد. عواملی که عاملهای هوش مصنوعی را از دیگر انواع هوش مصنوعی، مانند الگوریتمهای یادگیری ماشین، متمایز میکند، توانایی آنها در انجام اقدامات مستقل، حل مسائل و تعامل با دنیای واقعی در زمان واقعی، با نظارت انسانی حداقلی است.

عاملی مستقل

یکی از ویژگیهای اصلی تعریفکننده یک عامل هوش مصنوعی، استقلال و خودمختار بودن آن به معنای توانایی انجام وظایف به طور مستقل است. استقلال؛ به توانایی عامل در تعیین مسیر خود و انجام وظایف بدون نیاز به نظارت پیوسته انسانی اشاره دارد. برخلاف سامانههای هوش مصنوعی سنتی که اغلب نیاز به ورودی و نظارت مداوم انسان دارند، عاملهای هوش مصنوعی به طور خودکار تصمیمگیری میکنند و اقدامات لازم را انجام میدهند. از طرفی عاملهای هوش مصنوعی اساساً سامانههایی هدفمحور هستند و برای دستیابی به اهداف خاصی طراحی شدهاند. همین رفتار هدفمحور است که عاملهای هوش مصنوعی را از دیگر مدلهای هوش مصنوعی متمایز میکند که ممکن است تنها بر اساس ورودیهای از پیش تعریفشده عملکرد خاصی انجام دهند. برخلاف سامانههای معمولی هوش مصنوعی که محدود به وظایف خاص و کوتاهمدت هستند، عاملهای هوش مصنوعی قادرند تصمیماتی بگیرند که بهمرورزمان برای دستیابی به اهداف، راهبُردهای خود را به طور مستمر بهبود بخشند. این قابلیت برنامهپذیری بلندمدت بهویژه در حوزههای پیچیدهای؛ مانند مدیریت راهبردی یا بازارهای مالی که اهداف نهایی ممکن است با ظهور دادههای جدید تغییر کنند، بسیار مهم و حیاتی است.

عاملی برای انطباقپذیری

انطباقپذیری یکی دیگر از ویژگیهای عاملهای هوش مصنوعی است. این سامانهها بهویژه آنهایی که در چارچوبهای یادگیری عمیق و یادگیری تقویتی ساخته شدهاند، توانایی یادگیری بر مبنای نتایج تولیدی و تجربههای قبلی خود را دارند. ازاینرو این عاملها هنگامی که با محیط یا کاربر تعامل میکنند، به طور مستمر و پیوسته درک خود را از محیط بهبود میبخشند و از این شرایط جدید یاد میگیرند که باعث میشود در دستیابی به اهداف خود مؤثرتر عمل کنند. توانایی تعامل با محیط نیز یکی از اساسیترین ویژگیهای تعریفکننده عاملهای هوش مصنوعی است. عاملها معمولاً از طریق حسگرها، جریانهای داده یا ورودی کاربر اطلاعاتی را از محیط خود دریافت و درک میکنند و بر اساس این اطلاعات تصمیم میگیرند و اقدامات متناسب را انجام میدهند. این چرخه درک – تصمیم – عمل به عاملهای هوش مصنوعی این امکان را میدهد تا بتوانند برای شرایط غیرقابلپیشبینی پاسخ و اقدام مناسبی ارائه کند. این سطح از تعامل با محیط خارج، عاملهای هوش مصنوعی را از سامانههای خودکار سادهای که دستورات از پیش برنامهریزیشده را بدون هرگونه ظرفیت و توانایی برای انطباق با تغییرات پیشبینینشده انجام میدهند، متمایز میکند.

عاملی چالشزا

عاملهای هوش مصنوعی خودمختار بهعنوان یکی از پیشرفتهترین دستاوردهای فناوری نوین، توانایی تصمیمگیری و اقدام مستقل را در محیطهای پیچیده دارند که زمینهساز تحول اساسی در حوزههای بهداشت، صنعت و حتی زندگی روزمره شدهاند. اما بااینحال، همراه با این فرصتهای بینظیر، چالشها و تهدیداتی نیز به وجود آمدهاند که میتوانند تبعات جدی اخلاقی، اجتماعی و حتی امنیتی را به همراه داشته باشند.

چالش شفافیت

یکی از مهمترین چالشها در استفاده از این عاملهای خودمختار، مسئله شفافیت در فرایند تصمیمگیری آنهاست. به نحوه عملکرد این سامانهها معمولاً «جعبه سیاه» گفته میشود؛ به این معنا که نحوه عملکرد آنها بهقدری پیچیده و گاهی غیرقابلتفسیر است که حتی متخصصان و توسعهدهندگان آن نیز نمیتوانند به طور دقیق تشریح کنند که چرا یک عامل چنین تصمیم خاصی گرفته است. این عدم شفافیت، نهتنها اعتماد کاربران را به این فناوری کاهش میدهد، بلکه در شرایط بحرانی، مانند تصمیمگیریهای پزشکی یا خودروهای خودران، میتواند عواقب غیرقابلجبرانی به دنبال داشته باشد.

چالشهای اخلاقی

در کنار مسئله شفافیت، یکی از نگرانیهای اصلی این است که چگونه اطمینان حاصل کنیم که اقدامات عاملهای هوش مصنوعی با ارزشها و هنجارهای اخلاقی انسانی همراستا باشد. فرایند همراستایی؛ به معنای اطمینان از اینکه سامانههای مبتنی هوش مصنوعی تصمیماتی میگیرند که به نفع بشریت است، یکی از بزرگترین چالشهای تحقیقاتی در هوش مصنوعی امروز است. در بسیاری از موارد، تصمیمگیریهای اخلاقی نیازمند درک عمیق از بافت فرهنگی و اجتماعی است که عاملهای هوش مصنوعی فاقد آن هستند. عاملهای هوش مصنوعی غالباً در محیطهایی فعالیت میکنند که باید تصمیماتی بگیرند که از یک سو تصمیمی منطقی به نظر میرسد؛ اما از سویی دیگر ممکن است در تضاد با یک یا چند ارزش اخلاقی انسانی باشد. برای نمونه، اگر یک عامل هوش مصنوعی در شرایط تصادف جادهای مجبور به انتخاب میان جان چند انسان باشد، چه معیارهایی را برای اولویتبندی استفاده خواهد کرد؟

عاملهای هوش مصنوع همچنین خطر سوگیریهای ناعادلانه را در تصمیمگیری به همراه دارند. این سامانهها برای یادگیری به دادههای موجود وابستهاند و اگر دادههای آموزشی شامل سوگیریهای خاص مغرضانه یا حتی سهوی از نابرابریهای اجتماعی باشند، عاملهای هوش مصنوعی نیز به بازتولید این الگوهای تبعیضآمیز میپردازند. بهعنوانمثال، یک سامانه استخدامی مبتنی بر هوش مصنوعی ممکن است به دلیل آموزش بر روی دادههای مغرضانه گذشته، ملیت خاصی را ترجیح دهد. این مسئله نهتنها بر عدالت اجتماعی تأثیر منفی میگذارد، بلکه میتواند منجر به ازدسترفتن اعتماد عمومی به این فناوریها شود.

چالشهای امنیتی

یکی دیگر از نگرانیهای اساسی، امنیت این عاملها و تأثیر آنها بر حفظ حریم شخصی است. عاملهای هوش مصنوعی میتوانند هدف حملات سایبری قرار گیرند و درنتیجه، به طور نادرست عمل کنند یا حتی برای مقاصد مخرب مورد سوءاستفاده قرار گیرند. برای مثال، هکشدن یک عامل هوش مصنوعی در سامانههای مالی میتواند عواقب فاجعهباری به همراه داشته باشد و سبب ایجاد ضررهای مالی هنگفتی حتی در سطح جهانی شود. علاوه بر این، عاملهای هوش مصنوعی میتوانند خود بهعنوان ابزارهای نظارت گسترده و نقض حریم خصوصی استفاده شوند که تهدیدی جدی برای آزادیهای مدنی و حقوق بشر به شمار میآید.

موضوع امنیت شغلی و اثرات اقتصادی عاملهای هوش مصنوعی نیز از دیگر جنبههای مهمی است که باید مورد توجه قرار گیرد. با افزایش استفاده از این سامانهها در انجام وظایف تکراری و حتی مشاغل پیچیده، احتمال ازدسترفتن تعداد زیادی از فرصتهای شغلی وجود دارد. درعینحال، نابرابری درآمدی میان افراد دارای مهارتهای فنی پیشرفته و سایر افراد جامعه نیز به این واسطه میتواند تشدید شود. اگر سیاستگذاران نتوانند سیاستهایی برای بازآموزی و ارتقای مهارتهای کاری نیروهای انسانی وضع کنند، این فناوریها بهجای بهبود وضعیت اجتماعی، ممکن است منجر به افزایش شکاف طبقاتی شوند.

چالش مسئولیتپذیری

در کنار تمامی این چالشها، مسئله پاسخگویی و مسئولیتپذیری عاملهای هوش مصنوعی نیز بهشدت محل بحث است. اگر یک عامل هوش مصنوعی در تصمیمگیری خود خطا کند و این خطا منجر به خسارت شود، چه کسی باید پاسخگو باشد؟ سیاستگذاران، توسعهدهندگان، کاربران، یا شرکتهایی که این عاملها را به کار گرفتهاند؟ سؤالات مربوط به شخصیت حقوقی عاملهای هوش مصنوعی و اینکه آیا باید به آنها وضعیت اشخاص حقوقی با حقوق و مسئولیتهای خاص داده شود همچنان مسئلهای بحثبرانگیز باقیمانده است و سامانههای حقوقی فعلی برای مدیریت چنین موقعیتهایی آماده نیستند و این خلأ میتواند موجب سردرگمی و تضاد منافع در آینده شود.

همانطور که هوش مصنوعی در جامعه گسترش مییابد، توسعهدهندگانی سامانههای هوش مصنوعی را کنترل میکنند که شرکتهایی بزرگ با منابع داده عظیم هستند و کنترل و اشرافی بیسابقهای بر اطلاعات شخصی، تصمیمات و حتی هنجارهای اجتماعی به دست میآورند. انحصار فناوری هوش مصنوعی ممکن است نابرابری اقتصادی را در سطح بینالمللی تقویت کند، بهطوریکه گروهها یا کشورهای خاصی تأثیر بیشتری بر توسعه و استفاده از هوش مصنوعی خواهند داشت.

در برابر چالشهای چه کنیم؟

برای مقابله با این چالشها، ایجاد چارچوبهای نظارتی و اخلاقی جامع ضروری است. این چارچوبها باید بهگونهای طراحی شوند که ضمن حفظ نوآوری، مواردی حیاتیای مثل امنیت، شفافیت و مسئولیتپذیری را نیز تضمین کنند. بهعنوانمثال، استفاده از رویکرد «انسان در حلقه» (Human-in-the-Loop (HITL)) که نظارت انسانی را در تصمیمگیریهای کلیدی حفظ میکند، میتواند بهعنوان یک لایه حفاظتی عمل کند. همچنین، توسعهدهندگان باید تلاش کنند تا با افزایش شفافیت الگوریتمها و استفاده از ممیزیهای مستقل، اعتماد کاربران را جلب کنند. همچنین، همکاری میان دولتها، محققان و شرکتهای خصوصی برای ایجاد استانداردهای مشترک در سطح جهانی ضروری است. این همکاریها میتواند تضمین کند که توسعه و بهکارگیری عاملهای هوش مصنوعی، نهتنها برای بهبود کارایی و پیشرفت اقتصادی، بلکه برای بهبود کیفیت زندگی همه انسانها باشد.

عاملهای هوش مصنوعی خودمختار، همانگونه که میتوانند پیشرفتهای قابلتوجهی را به همراه داشته باشند، در صورت عدم مدیریت مناسب، خطرات جدی برای جامعه به دنبال خواهند داشت. اتخاذ رویکردی مسئولانه و آگاهانه در توسعه و استفاده از این سامانهها، تنها راهی است که میتوان اطمینان یافت که این فناوری بهجای تهدید، فرصتی برای بهبود زندگی انسانها ایجاد خواهد کرد.

عامل نوآوری محتاط

تکامل سریع عاملهای هوش مصنوعی آیندهای هیجانانگیز و درعینحال نامطمئن به همراه دارد. هوش مصنوعی میتواند در هر زمینهای بهرهوری را افزایش دهد بااینحال، ریسکهای همراه با این پیشرفتها قابلچشمپوشی نیستند. توسعه عاملهای هوش مصنوعی داستانی از ریسکهای بیضابطه نیست، بلکه داستانی از همکاری و مسئولیتپذیری است. با درگیرکردن ذینفعان مختلف میتوان درک مشترکی از چگونگی شکلدهی به آینده عاملهای هوش مصنوعی ایجاد کرد. ایجاد اعتماد از طریق شفافیت، مسئولیتپذیری و تعیین استانداردهای اخلاقی برای پذیرش گسترده عاملهای هوش مصنوعی بسیار حیاتی خواهد بود. این فناوری، زمانی که با دقت و آیندهنگری توسعه یابد، میتواند منافع عمیقی به همراه داشته باشد بدون اینکه ایمنی یا اصول اخلاقی فدای آن شود.

با نگاه به آینده، مسیر پیشِ رو نیازمند احتیاط و جسارت توأمان خواهد بود. ظرفیت عاملهای هوش مصنوعی برای بازسازی دنیای ما بسیار است، اما باید بادقت پیش برویم تا اطمینان حاصل کنیم که سامانههایی که ایجاد میکنیم با بهترین منافع ما بهعنوان افراد و جامعه هماهنگ باشند. با تعادل صحیح نوآوری و مقررات، عاملهای هوش مصنوعی میتوانند ابزارهای قدرتمندی باشند که زندگی انسانها را ارتقا دهند، نیروی انسانی را توانمند سازند و نیروی محرکه پیشرفت جهانی باشند.

در نهایت، چالش اساسی این نیست که آیا میتوانیم یک عامل هوش مصنوعی طراحی کنیم، بلکه این است که چگونه میتوانیم اطمینان حاصل کنیم که آنها توسط ارزشها انسانی هدایت میشوند. با رویکردی محتاطانه، آیندهنگرانه و همکاری همهجانبه، میتوانیم آیندهای بسازیم که در آن فناوری در کنار انسانیت عمل کند، توانایی ما را ارتقا دهد، از تلاشهای ما حمایت کند و کیفیت زندگی را برای همه انسانها بهبود بخشد.