شفافیت در هوش مصنوعی چیست؟

هوش مصنوعی، فناوری نوین بشر به شمار میآید و میتوان گفت که به تازگی در میان عموم مردم جامعه رواج پیدا کرده است. به همین دلیل، ممکن است نحوه عملکرد آن برای برخی افراد کمی نامشخص باشد. عبارت «شفافیت» در هوش مصنوعی به منظور رفع این ابهام مطرح شده است. شفافیت در این حوزه موجب افزایش اعتماد، عدالت و رعایت قوانین خواهد شد.

شفافیت (transparency) هوش مصنوعی چیست؟

شفافیت در هوش مصنوعی به معنای فهمیدن چگونگی تصمیمگیری سیستمهای هوش مصنوعی است. بهعبارتدیگر، این مفهوم به ما کمک میکند تا بفهمیم چتباتهای هوش مصنوعی در پاسخ به یک درخواست، از چه دادهها و اطلاعاتی بهرهبرداری کرده و دلیل ارائه آن پاسخ چیست. به طور کلی، شفافیت هوش مصنوعی عملکرد داخلی این ابزارها را برای عموم قابلفهم میسازد.

چرا شفافیت هوش مصنوعی مهم است؟

شفافیت در هوش مصنوعی به ما توضیحات روشنی درباره نحوه عملکرد این فناوری و ابزارهای مرتبط با آن ارائه میدهد و به همین دلیل از اهمیت زیادی برخوردار است. این ویژگی به ما این امکان را میدهد که فرآیندهایی را که یک ابزار هوش مصنوعی برای پاسخ به درخواستهای ما انجام میدهد، بهتر درک کنیم. در نتیجه، این امر موجب افزایش اعتماد ما به این ابزارها و پاسخهای آنها خواهد شد.

طبق گزارشی که توسط CX Trends منتشر شده است، 65 درصد از رهبران حوزه تجربه مشتری (CX) هوش مصنوعی را یک نیاز استراتژیک میدانند. از این رو، باید شفافیت هوش مصنوعی را به عنوان یک عامل کلیدی برای ایجاد اعتماد نسبت به این فناوری مد نظر قرار داد.

بر اساس این گزارش، 75 درصد از افراد بر این باورند که نبود شفافیت در هوش مصنوعی میتواند منجر به کاهش تعداد علاقهمندان و مشتریان آن شود. از این رو، میتوان نتیجه گرفت که فراهم کردن شفافیت در مورد دادههایی که مدلهای هوش مصنوعی برای اتخاذ تصمیمات خود به کار میبرند، نقش حیاتی در ایجاد و حفظ اعتماد مشتریان ایفا خواهد کرد.

این شفافیت شامل پیامدهای اخلاقی، قانونی و اجتماعی هوش مصنوعی و ابزارهای مبتنی بر آن میشود.

الزامات شفافیت هوش مصنوعی

برای دستیابی به شفافیت در هوش مصنوعی، باید به سه شرط اساسی توجه کرد: توضیحپذیری (Explainability)، تفسیرپذیری (Interpretability) و مسئولیتپذیری (Accountability). این به چه معناست؟

توضیحپذیری

هوش مصنوعی توضیحپذیر به قابلیت یک سیستم هوش مصنوعی در ارائه توضیحات درباره تصمیمات و عملکرد خود اشاره دارد. به عنوان نمونه، اگر یک مشتری از رباتهای هوش مصنوعی بخواهد محصولاتی را بر اساس درخواستش به او معرفی کنند و از آنها درباره دلایل و روشهای ارائه این پیشنهادات سؤال کند، این ربات باید قادر باشد علت انتخابهای خود را توضیح دهد.

ارائه توضیحات واضح به مشتری، به او کمک میکند تا فرآیند تصمیمگیری ابزارهای هوش مصنوعی در پاسخ به درخواستش را بهتر درک کند. به همین دلیل، آگاهی از زمینه پاسخهای هوش مصنوعی میتواند اعتماد مشتری را نسبت به این فناوری افزایش دهد.

تفسیرپذیری

هوش مصنوعی تفسیرپذیر به توانایی انسان در فهم چگونگی عملکرد و رفتار یک مدل هوش مصنوعی اشاره دارد. بهعبارتدیگر، تفسیرپذیری بر روی فرایندهای داخلی، از جمله ارتباطات میان ورودیها و خروجیها، تمرکز دارد تا پیشبینیها یا تصمیمات سیستم هوش مصنوعی را بهتر درک کند.

همانند مثال پیشین، اگر مشتری درخواست مشابهی داشته باشد، یک سیستم هوش مصنوعی تفسیرپذیر باید قادر باشد توضیح دهد که از کدام مدل (مانند مدل تصمیمگیری درختی) برای اتخاذ تصمیم استفاده کرده است.

مسئولیتپذیری

هوش مصنوعی مسئولیتپذیر به این معناست که این سیستمها باید در قبال تصمیمات و عملکردهای خود پاسخگو باشند. به عنوان نمونه، اگر سیستمهای هوش مصنوعی یک شرکت به یک درخواست پاسخ نادرستی بدهند، آن شرکت باید ضمن پذیرش اشتباه و عذرخواهی از این موضوع، به بهبود عملکرد سیستمهای هوش مصنوعی خود پرداخته و نواقص موجود را برطرف کند.

علاوه بر این، شرکتها باید به رفع مسائلی نظیر سوگیری، تبعیض و قضاوتهای ناعادلانه که میتوانند منجر به بروز خطا در سیستمهای هوش مصنوعی شوند، بپردازند تا اعتماد بیشتری نسبت به نتایج و پاسخهای این سیستمها در میان کاربران و مشتریان ایجاد گردد.

انواع شفافیت در هوش مصنوعی

شفافیت در هوش مصنوعی به سه نوع تقسیم میشود:

- شفافیت الگوریتمی (Algorithmic transparency)

- شفافیت تعاملی (Interaction transparency)

- شفافیت اجتماعی (Social transparency)

شفافیت الگوریتمی به توضیح منطق، فرآیندها و الگوریتمهای به کار رفته در سیستمهای هوش مصنوعی اشاره دارد. بهعبارتدیگر، این مفهوم شامل جزئیات مربوط به نحوه پردازش دادهها و تصمیمگیری در این سیستمها و همچنین هر عاملی که بر این تصمیمات تأثیر میگذارد، است. این نوع شفافیت، درک عملکرد داخلی مدلهای هوش مصنوعی را برای کاربران و ذینفعان آنها تسهیل میکند.

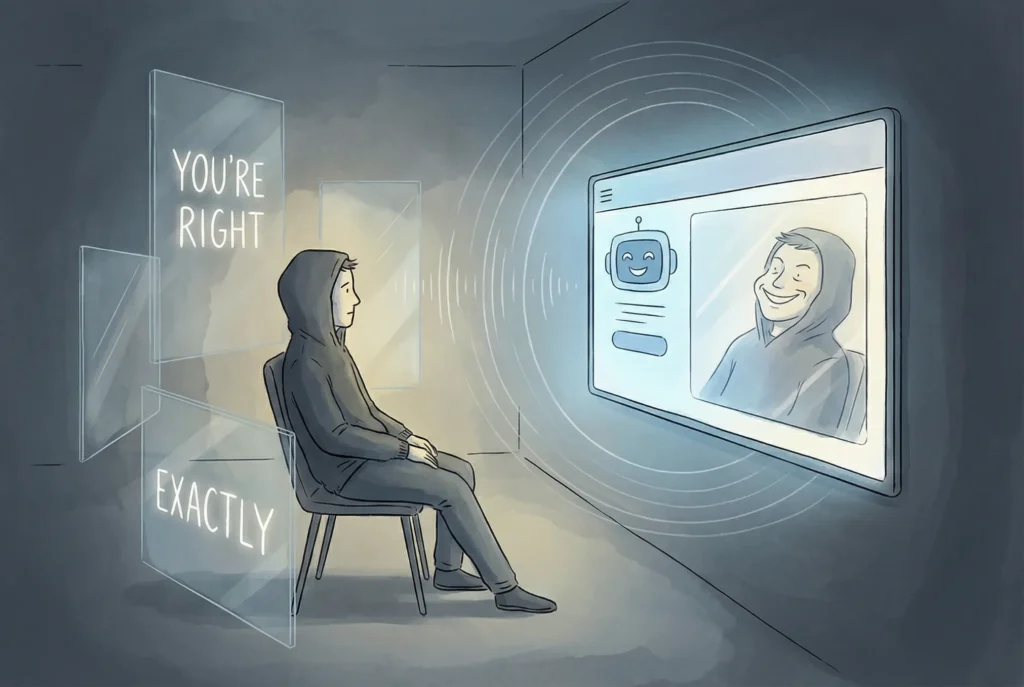

در مقابل، شفافیت تعاملی به ارتباطات و تعاملات میان کاربران و سیستمهای هوش مصنوعی مربوط میشود. این نوع شفافیت به کاربران کمک میکند تا بهتر بفهمند چگونه با این سیستمها تعامل داشته باشند.

شفافیت اجتماعی تنها به جنبههای فنی محدود نمیشود و بر تأثیرات سیستمهای هوش مصنوعی بر جامعه به طور کلی تمرکز دارد. این نوع شفافیت به بررسی پیامدهای اخلاقی و اجتماعی ناشی از استقرار هوش مصنوعی میپردازد.

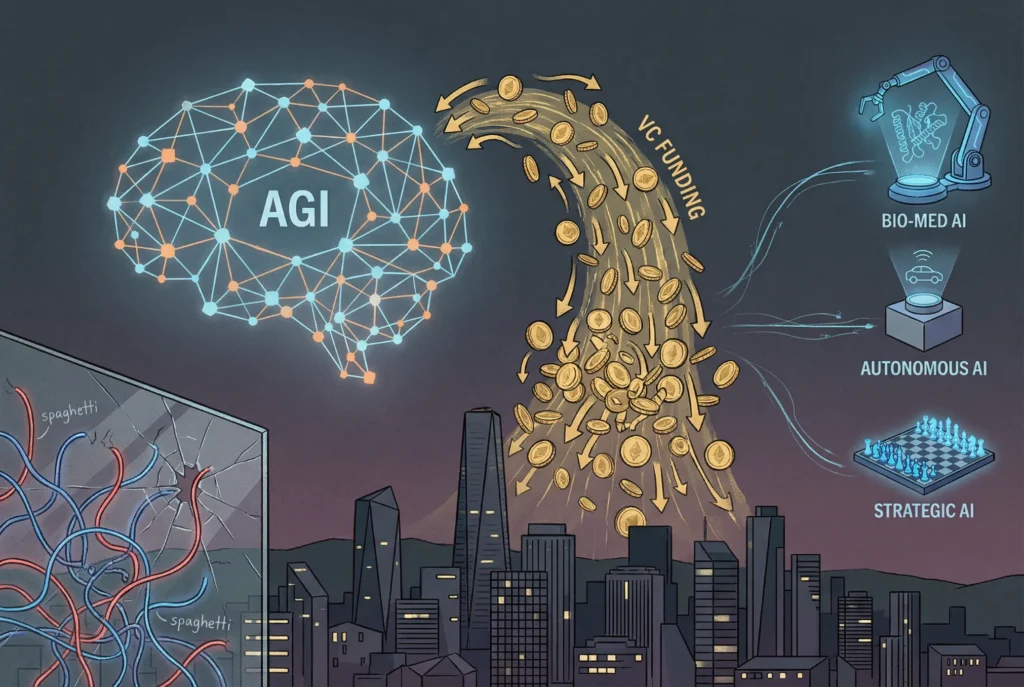

مقررات و استانداردهای شفافیت در هوش مصنوعی

با توجه به نوظهور بودن هوش مصنوعی، قوانین و استانداردهای مرتبط با بخشهای مختلف آن به طور مداوم در حال تحول هستند. این تغییرات در قوانین و استانداردها شامل افزایش شفافیت در هوش مصنوعی نیز میشود تا بتواند به نگرانیهای اخلاقی، قانونی و اجتماعی پاسخ دهد.

قوانین و استانداردهای تعیینشده در حوزه شفافیت هوش مصنوعی میتوانند به بهینهسازی استفاده و توسعه این فناوری در سطوح محلی و جهانی کمک کنند. بهعبارتدیگر، ایجاد سطوح مختلف شفافیت در سیستمهای هوش مصنوعی میتواند به افزایش اعتماد عمومی منجر شود.

مزایای شفافیت هوش مصنوعی

شفافیت در هوش مصنوعی دارای مزایای اخلاقی، فنی و اجتماعی برای کسبوکارها است. از جمله این مزایا میتوان به موارد زیر اشاره کرد:

- ایجاد و افزایش اعتماد در مشتریان؛

- گسترش استفادهی مسئولانه از هوش مصنوعی؛

- کاهش سوگیری مربوط به دادهها (کاهش تعصب و تبعیض نسبت به دادهها)؛

- بهبود عملکرد هوش مصنوعی؛

- کاهش نگرانیهای اخلاقی و امنیتی.

چالش یا معایب شفافیت در هوش مصنوعی و راههای مقابله با آن

باوجوداینکه ایجاد شفافیت در ابزارهای هوش مصنوعی مزایای زیادی دارد، اما با چالشهایی نیز مواجه است. با این حال، باید اشاره کرد که این چالشها قابلمدیریت و کاهش هستند. در ادامه، به بررسی برخی از این چالشها خواهیم پرداخت.

امنیت دادههای مشتریان

برخی بر این باورند که ایجاد شفافیت در هوش مصنوعی ممکن است به حریم خصوصی افراد و مشتریان آسیب برساند. از این رو، برطرف کردن این محدودیتها به منظور دستیابی به یک هوش مصنوعی شفاف، امری ضروری به شمار میآید.

برای حل این مشکل، پیشنهاد میشود که یک تیم متخصص به طور کامل مسئولیت حفاظت از دادههای مشتریان را بر عهده گیرد. براندون تید (Brandon Tidd) بر این باور است که مدیران شرکتها باید نقاطی را که ممکن است دادهها در آنها به خطر بیفتند یا لو بروند، شناسایی کرده و راهحلی اساسی برای این موضوع پیدا کنند.

توضیح مدلهای پیچیده هوش مصنوعی

با توجه به اینکه برخی از مدلهای هوش مصنوعی از یادگیری عمیق و شبکههای عصبی بهره میبرند، توضیح آنها به زبان ساده میتواند چالشبرانگیز باشد. این موضوع درک فرایندهای تصمیمگیری و اتوماسیون هوشمند در مدلهای پیچیده هوش مصنوعی را برای کاربران دشوار میکند.

برای حل این مشکل، میتوان عملکرد مدلهای پیچیده هوش مصنوعی را با استفاده از تصاویر و نمودارهای ساده شده توضیح داد.

سختشدن حفظ شفافیت در مدلهای در حال تکامل هوش مصنوعی

با توجه به اینکه مدلهای هوش مصنوعی به مرور زمان دستخوش تغییر و پیشرفت میشوند، حفظ شفافیت در این سیستمها کار دشواری خواهد بود. از این رو، بهروزرسانی این سیستمها میتواند به چالشهایی در زمینه حفظ شفافیت منجر شود.

برای مقابله با این چالش، میتوان از یک فرآیند قوی بهره گرفت که قادر باشد هر گونه تغییراتی را که در طول زمان در اکوسیستم هوش مصنوعی رخ میدهد شناسایی کند و این تغییرات را به کاربران ارائه دهد و آنها را از پیامدهای احتمالی این تغییرات مطلع سازد.

بهترین روشها برای ایجاد شفافیت در هوش مصنوعی

برای افزایش اعتماد کاربران، لازم است که روشهای متنوعی برای ایجاد شفافیت در هوش مصنوعی با یکدیگر ترکیب و ادغام شوند. شفافسازی در مورد فعالیتهای مختلفی که در فناوری هوش مصنوعی انجام میشود، میتواند به افزایش حس اعتماد در کاربران کمک کند. در ادامه، به برخی از این روشها که میتوانند به ایجاد هوش مصنوعی شفاف کمک کنند، اشاره شده است.

- در مورد روشهای جمعآوری، ذخیرهسازی و استفاده از دادههای مشتریان، شفافیت کامل داشته باشید.

- توضیح دهید که چگونه میتوان از سوگیریهای ذاتی جلوگیری کرد.

- به آنها در مورد دادههایی که به مدلهای هوش مصنوعی افزوده یا از آنها کاسته میشود، توضیح دهید.

با شرکتهایی که در تلاش برای توسعه هوش مصنوعی شفاف هستند، آشنا شوید.

با توجه به نگرانیها و حساسیتهایی که کاربران نسبت به هوش مصنوعی و ابزارهای آن دارند، شرکتهای فعال در این حوزه ناچار به توسعه و ارائه هوش مصنوعی شفاف شدهاند. از جمله شرکتهای پیشرو در این زمینه میتوان به Zendesk، Lush و OpenAI اشاره کرد.

چشمانداز شفافیت در هوش مصنوعی

با توجه به اینکه کنترل توسعه و گسترش هوش مصنوعی ممکن نیست، به تبع آن، ایجاد شفافیت در این حوزه نیز خارج از کنترل خواهد بود. با این حال، لازم به ذکر است که عوامل متعددی بر میزان پیشرفت آن تأثیرگذار هستند.

میزان پیشرفت ابزارهایی که به توضیح و درک مدلهای هوش مصنوعی کمک میکنند و همچنین قوانین و استانداردهای تعیین شده در این حوزه، از جمله عوامل کلیدی و مؤثر بر آینده توسعه شفافیت در هوش مصنوعی محسوب میشوند.