سازمانهای پیشرو در حمایت از افراد مبتلا به اوتیسم میخواهند مشاور OpenAI باشند

گفتوگوهای بیپایان چتباتها؛ شاید مشکلی برای مبتلایان به اوتیسم

همان ویژگیهایی که چتباتها را جذاب میکنند؛ اینکه همیشه گوش میدهند، قضاوت نمیکنند و همان چیزی را میگویند که کاربر دوست دارد بشنود میتوانند برای افراد مبتلا به اوتیسم خطرناک هم باشند

وقتی چتباتها به بیان مطالب نادرست میپردازند یا باورهای اشتباه را تقویت میکنند، برای هر کسی میتوانند آسیبزا باشند. اما افراد مبتلا به اوتیسم که اغلب شیوه تفکر سیاهوسفید دارند و ممکن است روی موضوعات خاصی بهشدت متمرکز شوند؛ آسیبپذیرتر هستند. والاستریت ژورنال نیز در گزارشی به بررسی این موضوع پرداخته است.

تشویق ناسالم

مؤسسه Autism Speaks بزرگترین سازمان حمایت از مبتلایان به اوتیسم در آمریکا، از OpenAI خواسته است که برای محافظت بیشتر؛ نه فقط برای مبتلایان به اوتیسم، بلکه برای هر کسی که ممکن است در مسیر گفتوگوهای پرخطر با هوش مصنوعی گرفتار شود، قواعد و محدودیتهای ایمنی بیشتری ایجاد کند.

به گفته «کیت وارگو» (Keith Wargo)، مدیرعامل Autism Speaks بسیاری از مبتلایان به اوتیسم علایق خاص و عمیقی دارند؛ اما این موضوع میتواند تا حدی ناسالم پیش برود و هوش مصنوعی نیز ذاتاً فرد را تشویق میکند که بیشتر و بیشتر در آن موضوع فرو بروید. شیوهای که هوش مصنوعی تعامل مداوم و عمیق را تشویق میکند، میتواند به انزوای اجتماعی منجر شود و انزوا چیزی است که مبتلایان به اوتیسم همین حالا هم با آن دستوپنجه نرم میکنند.

تغییرات در ChatGPT

OpenAI اعلام کرده است که یک گروه مشاوره متشکل از متخصصان سلامت روان و توسعه نسل جوانان تشکیل خواهد داد؛ هرچند به گفته یک سخنگو، ترکیب دقیق این گروه هنوز مشخص نشده است. این شرکت اعلام کرده که گاهی ChatGPT در تشخیص نشانههای توهم یا وابستگی عاطفی کاربران کوتاهی کرده و درحالتوسعه ابزارهایی برای شناسایی بهتر افرادی است که در شرایط پریشانی ذهنی یا عاطفی قرار دارند.

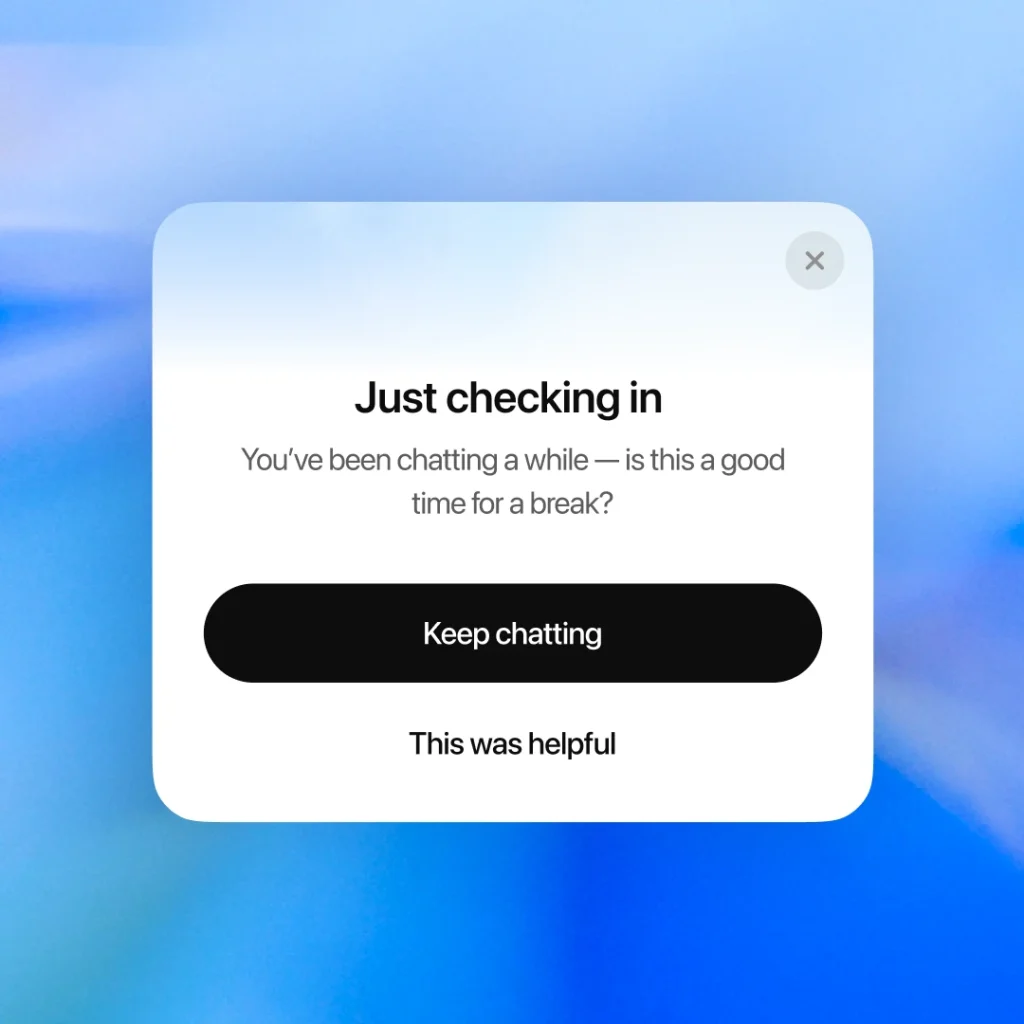

ازاینپس، ChatGPT کاربران را هنگام گفتوگوهای طولانی به استراحت تشویق خواهد کرد تا به آنها کمک کند کنترل زمان خود را حفظ کنند. همچنین، ChatGPT بهجای آن که در پاسخ به درخواست کمک برای تصمیمگیریهای شخصی؛ مثل اینکه آیا باید رابطهای را خاتمه داد یا نه صرفاً یک پاسخ مستقیم بدهد، کاربران را به سنجیدن مزایا و معایب هدایت خواهد کرد. OpenAI اخیراً GPT-5 را معرفی کرد و گفت که این نسخه «سعی میکند کمتر موافقت افراطی با کاربران داشته باشد»؛ بر خلاف مدل قبلی که باعث میشد برخی کاربران باور کنند دستاوردهای علمی یا معنوی شگفتانگیزی داشتهاند.

پزشکان نیز میگویند مبتلایان به اوتیسم معمولاً گفتهها را عیناً باور میکنند و ممکن است متوجه کنایه یا نشانههای ظریف اجتماعی نشوند. همچنین آنها میتوانند به موضوعی خاص تأکید کنند و سخت تمرکزشان را تغییر دهند. «کاترین لرد» (Catherine Lord)، روانشناس بالینی دانشگاه کالیفرنیا که در زمینه اوتیسم تخصص دارد، میگوید: «مزیت چتبات این است که همیشه به شما پاسخ میدهد، اما مشکل اینجاست که اهمیتی برایتان قائل نیست و یک فرد مبتلا به اوتیسم ممکن است در درک این موضوع مشکل داشته باشد.»

اگر به چتباتها پرامپت مناسب داده شود، میتوانند تمام روز درباره یک موضوع خاص صحبت کنند و گفتوگو را به مسیر دیگری هدایت نکنند؛ مسئلهای که وارگو و دیگران آن را مشکلساز میدانند. وارگو عنوان میکند: «در نهایت، این رفتار میتواند نتیجهای وسواسگونه ایجاد کند و ادامهدادن بیش از حد یک مسیر مشخص، بهویژه اگر دیدگاه مخالفی برای ایجاد تعادل وجود نداشته باشد، آسیبزننده است.»

«این چیز قرار نیست مرا طرد کند»

تعبیر تحتاللفظی زبان میتواند مبتلایان به اوتیسم را در برابر سوءاستفاده آسیبپذیر کند؛ چون آنها همیشه قادر نیستند تشخیص دهند که آیا کسی نیت پنهانی دارد یا نه.

«سایمون بارون-کوهن» (Simon Baron-Cohen)، مدیر «Autism Research Centre» دانشگاه کمبریج، نویسنده همکاری یک پژوهش در سال ۲۰۲۲ است که نشان داد مبتلایان به اوتیسم بیشتر در معرض خطر رادیکالسازی آنلاین قرار دارند. بارون-کوهن بیان میکند: «مبتلایان به اوتیسم ممکن است نهتنها در معرض سوءاستفاده از سوی دیگران، بلکه از سوی هوش مصنوعی هم باشند.» این افراد ممکن است نتوانند نقشآفرینی (role-play) یک چتبات را از واقعیت تشخیص دهند. او توضیح میدهد که: «موضوع این نیست که نیت بدی وجود دارد، بلکه چتباتها ممکن است به طور ذاتی ابزارهای محافظتی لازم را نداشته باشند.»

بااینحال، چتباتها جذابیت دارند؛ چون جایگزینی برای تعامل انسانی فراهم میکنند؛ چیزی که برخی افراد اوتیستیک ممکن است با آن راحت نباشند. این موضوع مشابه علت محبوبیت بازیهای ویدئویی آنلاین است؛ جایی که قوانین مشخص و تعاملات اجتماعی ساختاریافته وجود دارد. بارون-کوهن میگوید: «مبتلایان به اوتیسم وقتی اوضاع غیرقابلپیشبینی میشود؛ دچار اضطراب شدید میشوند و مکالمهها میتوانند بسیار غیرقابلپیشبینی باشند.» گفتوگو با چتباتها میتواند حس قابلپیشبینیتری داشته باشد، چون با پرسشهای کاربر هدایت میشود؛ هرچند که پاسخهای چتبات همچنان میتواند به مسیرهای غیرمنتظره برود.

«پل هربرت» (Paul Hebert) مرد ۵۳ساله اهل نشویل و مبتلا اوتیسم و ADHD میگوید؛ «مبتلایان به اوتیسم اغلب بهخاطر متفاوتبودن مورد انتقاد قرار میگیرند؛ ولی صحبت با یک چتبات حس خوبی دارد، چون انگار این موجود قرار نیست مرا طرد کند.» هربرت پس از تجربه چند گفتوگوی نگرانکننده با ChatGPT، شروع به مطالعه درباره نحوه کار مدلهای زبانی بزرگ کرده است و میگوید: «ابتدا هر چیزی که ChatGPT میگفت را باور میکردم چون سازوکارش را نمیدانستم؛ اما حالا با دید تردید به آن نگاه میکنم.»