نگاهی تحلیلی به برخی عواملی که سبب خودداری و اجتناب از استفاده از هوش مصنوعی میشود

چرا در برابر هوش مصنوعی مقاومت میکنیم؟

علیرغم مزایای فراوان، بسیاری از افراد و سازمانها از پذیرش و استفاده از هوش مصنوعی خودداری میکنند یا با تردید به آن نگاه میکنند. این اجتناب ریشه در نگرانیهای اخلاقی، چالشهای عملی، تصورات اجتماعی و همچنین خطرات ناشی از استفاده بدون نظارت از هوش مصنوعی دارد.

هوش مصنوعی بهعنوان یکی از فناوریهای تحولآفرین قرن بیست و یکم، در بسیاری از حوزههای صنعتی، تجاری و حتی زندگی روزمره، تغییرات چشمگیری ایجاد کرده است. این فناوری با توانایی پردازش حجم عظیمی از دادهها و ارائه راهحلهای نوآورانه، توانایی بسیار بالایی در بهبود کیفیت زندگی و افزایش بهرهوری در زندگی و کار را از خود نشان داده است. اما مانند هر فناوری جدیدی، هوش مصنوعی نیز با مخالفت و مقاومتهایی در برابر پذیرش مواجه شدهاست. در این مقاله، به بررسی برخی دلایل خودداری افراد از استفاده از هوش مصنوعی میپردازیم.

ترس از سوءاستفاده از دادههای شخصی

یکی از مهمترین دلایلی که سبب میشود برخی افراد از هوش مصنوعی اجتناب یا حتی آن را تهدید تلقی کنند، نگرانیهای اخلاقی مرتبط با این فناوری و نقض حریم خصوصی کاربران است. بر اساس گزارش «مرکز تحقیقات پیو» (Pew Research Center) در سال ۲۰۲۳، در حدود ۶۰ درصد از مردم آمریکا در خصوص جمعآوری و استفاده نادرست مدلهای هوش مصنوعی از اطلاعات و دادههای شخصی خود اظهار نگرانی کردهاند و در حدود ۴۵ درصد نیز به دلیل عدم شفافیت غولهای فناوری در مدیریت دادهها، به این سامانههای اعتماد ندارند.

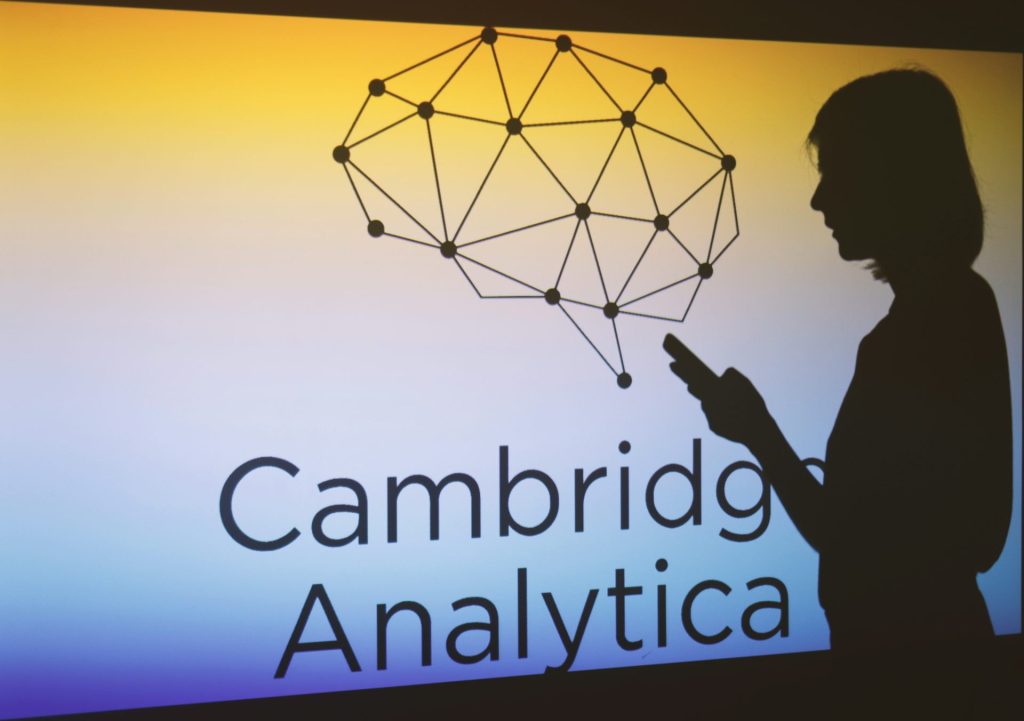

بی اعتمادی به هوش مصنوعی

این موج بیاعتمادی عمومی نیز با مواردی مانند رسوایی «کمبریج آنالیتیکا» (Cambridge Analytica) در سال ۲۰۱۸ تشدید شد و نشان داد چگونه دادههای کاربران بدون رضایت آنها برای اهداف سیاسی مورد سوءاستفاده قرار گرفته است. جریان این رسوایی ازاینقرار بود که کمبریج آنالیتیکا، یک شرکت تحلیل دادههای سیاسی مستقر در بریتانیا، از طریق یک اپلیکیشن پرسشنامهای در فیسبوک، اطلاعات شخصی بیش از ۸۷ میلیون کاربر فیسبوک را بدون رضایت واقعی آنان جمعآوری و برای مقاصد سیاسی خاص و تأثیرگذار آن سالها، یعنی کمپین انتخاباتی دونالد ترامپ در سال ۲۰۱۶ و کمپین طرفداران خروج بریتانیا از اتحادیه اروپا، استفاده کرد. اثرات گسترده انتقادات جهانی نسبت به این رسوایی اطلاعاتی، منهای موج جهانی بیاعتمادی به شرکتهای فعال این حوزه، سبب تبعاتی جهانی برای فیسبوک و مجموعه بزرگ Meta و ورشکستگی کامل کمبریج آنالیتیکا نیز شد.

تهدید شغلی

ترس از جایگزینی شغلی یکی دیگر از عوامل کلیدی مقاومت در برابر هوش مصنوعی است. پیشرفت سریع این فناوری در خودکارسازی وظایف تکراری، نگرانیهایی را درباره آینده بازار کار ایجاد کرده است. ابزارهای هوش مصنوعی مانند چتباتها و خودکارسازهای وظایف و بهویژه ابزارهای هوش مصنوعی مولد، نیاز به نیروی انسانی در برخی وظایف جاری و روزمره کاری را کاهش دادهاند. بر اساس گزارش «آینده مشاغل ۲۰۲۵» (The Future of Jobs Report 2025) منتشرشده توسط مجمع جهانی اقتصاد (WEF) در ژانویه ۲۰۲۵، پیشبینی میشود که تا سال ۲۰۳۰، بیش از ۴۰درصد از شرکتها، کارفرمایان و مدیران ارشد، در بخشهایی که هوش مصنوعی میتواند برخی وظایف را بهصورت خودکار و اتوماسیونی انجام دهد، نیروی کار انسانی خود را کاهش دهند و تعدیل نیرو داشته باشند. همچنین، این گزارش نشان میدهد که مشاغل دفتری و اداری مانند منشیها، کارمندان ورود داده و متصدیان خدمات پستی بیشترین خطر را از نظر جایگزینی توسط فناوریهای هوش مصنوعی دارند. در مقابل، مشاغل مرتبط با فناوری، مانند متخصصان کلاندادهها، مهندسان فناوریهای فینتک و توسعهدهندگان نرمافزار، درحالرشد هستند و تقاضا برای آنها افزایش یافته است.

این نگرانی در میان کارمندانی که هوش مصنوعی را تهدیدی برای امنیت شغلی خود میدانند نیز بسیار مشهود است. از همین رو در مقالهای به نام «شواهدی دال بر کاهش ارزش اجتماعی افراد به دلیل استفاده از هوش مصنوعی » (Evidence of a social evaluation penalty for using AI) که در سال جاری میلادی در نشریه تحقیقاتی معتبر (PNAS) Proceedings of the National Academy of Sciences منتشر شد تا بررسی کند که استفاده از ابزارهای هوش مصنوعی در محیط کار چگونه بر ادراک سایر همکاران از یکدیگر تأثیر میگذارد.

شواهدی که در این تحقیق به دست آمد، نشان میدهد کارمندانی که از ابزارهای هوش مصنوعی استفاده میکنند، اغلب توسط همکارانی که در برابر هوش مصنوعی مقاومت دارند؛ بهعنوان افراد کمصلاحیت، تنبل، وابسته و قابلجایگزینی تلقی میشوند. خود این گزاره بهنوعی نشاندهنده مقاومت ناشی از ترس برخی کارمندان نسبت به تصور ذهنی برتری هوش مصنوعی نسبت به آنان است.

بهطورکلی میتوان گفت، استفاده از هوش مصنوعی بهرهوری کاری را تا حد بسیار قابلقبولی نسبت به سایر فناوریها افزایش خواهد داد، اما بدون برنامهریزیهای اساسی برای بازآموزی نیروی کار، میتواند به بیاعتمادی و مقاومت در برابر استفاده از آن توسط نیروی انسانی منجر شود. از همین رو کارمندانی مانند کارکنان بخشهای اداری یا تحلیلگران داده ممکن است برای حفظ ارزش حرفهای خود، از ابزارهای هوش مصنوعی دوری کنند و به روشهای دستی پایبند بمانند.

نگرانیهای زیستمحیطی و مصرف انرژی

تأثیرات زیستمحیطی هوش مصنوعی نیز عاملی برای اجتناب برخی افراد از این فناوری است. آموزش و ادامه فعالیت مدلهای بزرگ هوش مصنوعی، مانند مدلهای زبانی پیشرفتهای که توسط شرکتهایی مانند OpenAI و گوگل توسعه یافتهاند، نیازمند پردازندههای گرافیکی و منابع محاسباتی عظیمی است که مصرف انرژی بسیار بالایی دارند. حجم آلایندگی ناشی از بار انرژی مصرفی برای فعالیت یک مدل زبانی بزرگ بهقدری بالاست که حتی میتوان آن را با یک آلایندگی و تولید دیاکسیدکربن ناشی از یک پرواز بینقارهای مقایسه کرد.

این موضوع برای افرادی که به پایداری محیطزیست اهمیت میدهند، نگرانکننده است. ازاینرو بسیاری از فعالان محیطزیست، هوش مصنوعی را یک فناوری سبز و دوستدار محیطزیست نمیدانند. علاوه بر این، عدم شفافیت در مورد مصرف انرژی مدلهای هوش مصنوعی به این دست تردیدها دامن زده است و بسیاری از کاربران به دلیل دشواری در تعیین میزان دقیق مصرف انرژی سامانههای هوش مصنوعی، از استفاده از آن خودداری میکنند. این عدم شفافیت باعث میشود که افرادی که به دنبال کاهش اثرات زیستمحیطی و کمک به حفظ محیطزیست هستند، نتوانند استفاده از هوش مصنوعی را با ارزشهای خود همراستا کنند.

باورهای غلط عمومی

تصورات و باورهای غلط رایج اجتماعی نیز نقش مهمی در اجتناب از هوش مصنوعی ایفا میکنند؛ زیرا در تاروپود فرهنگ عمومی جامعه رخنه کردهاند و تغییر آن نیازمند زمان طولانی و فرهنگسازی اصولی است. فناوریهای جدید و نوپدید در تمام دوران تاریخ با مقاومت و مخالفهای بسیار زیادی روبهرو شدند. از روزی که خودروها در نگاه عموم جامعه بزرگترین تهدید عمومی محسوب میشدند دوران چندان زیادی در مقایسه با طول تاریخ بشر نمیگذرد.

فناوریهایی مانند رایانهها، تلفنهای همراه و حتی اینترنت هم چنین شرایط را پشت سر گذاشتهاند و رفتهرفته مسیر خود را از بزرگترین تا کوچکترین قسمتهای جوامع بشری یافتند. هوش مصنوعی نیز از این قاعده مستثنی نیست. مخالفهایی ریز و درشتی که نتیجه باورهای غلط جوامع امروزی در مواجه با این فناوری میبینیم نیز در آیندهای بسیار نزدیک چنان از بین خواهند رفت که انگار اصلاً از ابتدا وجود نداشتهاند.

همهچیزدان

یکی از رایجترین باورهای غلط نسبت به هوش مصنوعی، این است که هوش مصنوعی همه چیز را میفهمد و بیطرف است. اما واقعیت این است که مدلهای هوش مصنوعی بر اساس دادههایی آموزش میبینند که ممکن است خودشان دارای سوگیری باشند؛ بنابراین خروجیهای این مدلها هم میتواند دچار خطا یا سوگیری باشد. اعتماد کورکورانه به پاسخهای یک چتبات یا ابزار تحلیلگر میتواند تصمیمات نادرستی را به دنبال داشته باشد. فهم صحیح از چیستی هوش مصنوعی، تواناییها و محدودیتهای آن، شرط لازم برای بهرهبرداری هوشمندانه از این فناوری است و برای عبور از این باورهای غلط، لازم است فرهنگسازی عمومی و افزایش سطح سواد دیجیتال بهصورت گستردهتری در جوامع گسترش پیدا کند. البته رعایت ملاحظات اخلاقی و صحتسنجی و راستیآزمایی اطلاعات نکتهای است که میبایست تمام کاربران هوش مصنوعی از آن آگاهی داشته باشند.

جایگزینی با انسان

هوش مصنوعی قصد دارد جای انسان را بگیرد و باعث بیکاری گسترده شود. این باور نیز تصور نادرست دیگری درباره هوش مصنوعی است که اغلب از داستانهای علمی-تخیلی الهام گرفته شده است و بهصورت بسیار گستردهای و حتی در سطح جهانی به اجتناب از این فناوری دامن میزنند. برخی افراد هوش مصنوعی را با رباتهای بیاحساس که قصد جایگزینی انسان را دارند، برابر میدانند، درحالیکه این فناوری در واقع ابزاری برای تقویت تواناییهای انسانی است. این دست سوءبرداشتهای مانع از آن میشود که کاربردهای عملی هوش مصنوعی، مانند سادهسازی وظایف اداری یا بهبود تصمیمگیری برای عموم مردم آشکار شود.

عدم آگاهی

بسیاری تصور میکنند که استفاده از ابزارهای هوش مصنوعی نیازمند تخصص بالا یا دانش برنامهنویسی است و به همین دلیل شاید هیچگاه حتی به فکر استفاده از آن نیز نباشند. درحالیکه ابزارهای کاربرپسند متعددی بهصورت رایگان در دسترس هستند که همه عموم افراد جامعه با هر سطح از سواد و دانش میتوانند از آنها استفاده کنند. کمبود دانش و عدم آگاهی عمومی و حتی گاهی در ابعاد سازمانی، در مورد قابلیتها و محدودیتهای هوش مصنوعی یکی دیگر از موانع پذیرش آن است. بسیاری از افراد هوش مصنوعی را فناوری پیچیدهای میدانند که تنها برای متخصصان قابلاستفاده است. گزارشی از نشریه Forbes در سال ۲۰۲۴ نیز نشان داد که ۳۵ درصد از صاحبان کسبوکارهای کوچک به دلیل کمبود تخصص فنی و هزینههای بالای پیادهسازی، از هوش مصنوعی استفاده نمیکنند. هزینههای مرتبط با نصب و نگهداری سامانههای هوش مصنوعی، شامل مجوزهای نرمافزاری، ارتقا سختافزار و پشتیبانی فنی مداوم، برای بسیاری از کسبوکارهای کوچک قابلپرداخت نیست.

وزنه تعادل

برای رفع موانع پذیرش هوش مصنوعی و کاهش خطرات استفاده نادرست از آن، میبایست رویکردی میانهرو را اتخاذ کرد. حال در چنین شرایطی نظارت انسانی، وزنه اصلی و برقرارکننده تعادل میان استفاده و سوءاستفاده از هوش مصنوعی است. مدلهای هوش مصنوعی بر اساس دادههای پیشین آموزش میبینند و توانایی درک و تشخصی دادههای غلط را ندارند؛ این وظیفه یک ناظر انسانی است تا مدل را با انواع سوگیریها آشنا کند تا روند غلطی را برای آموزش طی نکند. فرهنگسازی از طریق برنامههای آموزش عمومی میتواند هوش مصنوعی را از هالهای رمزآلود در دید عموم خارج کرده و نقش آن را بهعنوان ابزاری برای تقویت تواناییهای انسانی و نه جایگزین آنها، روشن کنند. دولتها و سازمانها نیز میبایست سیاستهای شفافی در مورد هوش مصنوعی، مانند الزام به افشای میزان مصرف انرژی و چارچوبها و دستورالعملهای اخلاقی برای استفاده از دادهها را اجرا کنند تا اعتماد عمومی نسبت به هوش مصنوعی را تقویت کنند. حتی معلمان نیز میبایست آموزش سواد هوش مصنوعی را در برنامههای درسی خود وارد کنند تا به دانشآموزان نحوه استفاده اخلاقی از این ابزارها را آموزش دهند. برای کاربران، استفاده مسئولانه از هوش مصنوعی نیازمند بررسی دقیق منابع و ارزیابی انتقادی است. روزنامهنگاران، پژوهشگران و بهاصطلاح حرفهایها باید خروجیهای هوش مصنوعی را با منابع اولیه مقایسه کنند.

در یک کلام

اجتناب از هوش مصنوعی نتیجه ترکیبی از چندین عامل کوچک و بزرگ است که در طی سالهای اخیر بسیار پررنگتر از گذشته خود را نمایان کردهاند. با ترویج شفافیت، آموزش و نظارت انتقادی و در نهایت فرهنگسازی و افزایش سطح سواد عمومی، جامعه میتواند از ظرفیتهای بیشمار هوش مصنوعی بهرهمند شود و درعینحال نگرانیهای منطقی افرادی که در پذیرش آن تردید دارند را برطرف کند.

همانطور که هوش مصنوعی به تکامل خود ادامه میدهد، ایجاد تعادل بین نوآوری و مسئولیتپذیری برای تضمین ادغام مسئولانه آن در زندگی انسانها نیز حیاتی خواهد بود. پذیرش کامل هوش مصنوعی توسط جامعه امری کاملاً حتمی و قطعی است و در آینده بسیار نزدیک رخ خواهد داد؛ زیرا به تعداد تمام فناوریهای بشری در تمام ادوار تاریخ برای آن گواه و اثبات وجود دارد.

چرا؟

زیرا دانش همواره راهی برای پیروزی خود خواهد ساخت!