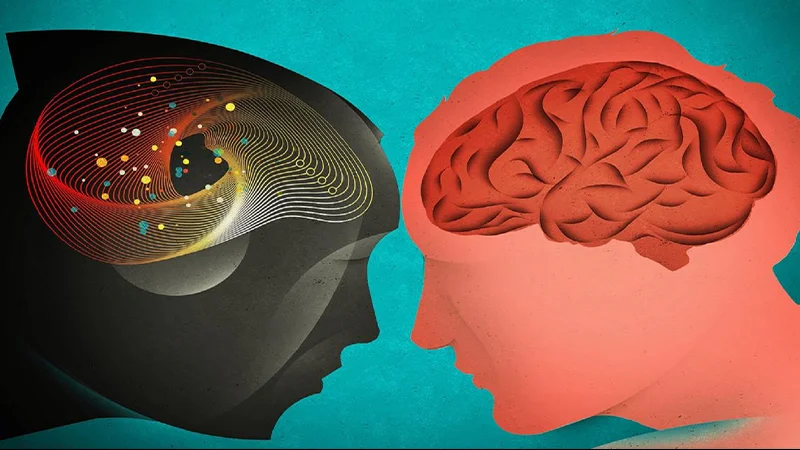

آموزش هوش مصنوعی با تقلید از مغز انسان

آیا میتوانیم به رباتها آموزش دهیم که آموختههایشان را عمومی کنند؟ چطور الگوریتمها میتوانند منطقیتر باشند؟ آیا سبک یادگیری یک بچه میتواند روی هوش مصنوعی تاثیر بگذارد؟ آموزش هوش مصنوعی به چه صورت انجام می شود؟

اینها مواردی است که در کنفرانس پاییزی بخش هوش مصنوعی انسانمحور موسسه استنفورد Stanford Institute for Human-Centered Artificial Intelligence، مطرح شدند. در این کنفرانس همچنین پرسشهایی در این باره که چطور میتوان باعث پیشرفت متقابل و درک بهتر هوش مصنوعی و هوش انسانی شد، وجود داشت. زمینه این رویداد «سه زاویهای کردن هوش» با هوش مصنوعی، علوم اعصاب و روانشناسی به منظور بهرهوری از اپلیکیشنهای مقیاس بزرگ بود.

کریستوفر منینگ، دانشیار بخش هوش مصنوعی انسانمحور استنفورد، پروفسور یادگیری ماشین و زبانشناسی و علوم کامپیوتر به همراه سوریا گانگولی، دانشیار عصبشناسی استنفورد، مجریان این کنفرانس بودند.

سخنرانان رویکردهای پیشرفتهای را توصیف کردند که برخی قبلا وجود داشتند و برخی جدید هستند. در هر دو صورت هم جریان اصلی بر اساس تحقیقات بر روی هوش مصنوعی و تقلید از مغز انسان بوده است.

قدرت تقویت عمیق

متیو بوتوینیک، مدیر تحقیقات علوم عصبشناسی دیپ مایند، یک بررسی جامع از پیشرفت شرکتهای تحقیقاتی هوش مصنوعی در زمینه استفاده از یادگیری تقویتی در اپلیکیشنهای هوش مصنوعی و طرحهای اولیه روانشناسی و عصبشناسی، ارائه کرد.

برای مثال در سال 2015، دیپ مایند ماشینهایی را آموزش داد که بازی کلاسیک آتاری را در سطح فراانسانی انجام دهند و بعد این رویکرد را گسترش داد تا بازیهای پیچیدهتر مانند «استارکرفت» و «گو» را هم انجام دهد. اخیرا هم تا انجام بازیهای چند نفره مانند “پرچم رو بگیر” پیش رفته است.

این باعث شده است تا ایدههای خوبی با استفاده از طرحهای اولیه برگرفته از روانشناسی تکوینی تا رفتار حیوانات، به دست آید. برای مثال دیپ مایند در حال توسعه دادن شبکه عصبی مبتنی بر هوش مصنوعیای است که برای آن از مفاهیم پیشرفته یادگیری تقویت دوپامین-محور dopamine-based reinforcement learning در انسانها، بهره میبرد. بوتوینیک در این باره میگوید:«با استفاده از مواردی که از مغز انسان یاد گرفتیم، به هوش مصنوعی کمک میکنیم پیشبینیهای بهتری داشته باشد».

این تیم متوجه شده که مغز به جای این که فقط متوجه شود در شرایط خاص پاداشی وجود دارد یا نه، میتواند نوع پاداشها را هم حدس بزند. با این روش است که باعث میشود انسانها تصمیمات بهتری بگیرند. سیستمهای هوش مصنوعی هم میتوانند به همین شکل آموزش داده شوند.

رویکرد مدلسازی با دو روش

دن یامینز، استادیار روانشناسی و کامپیوتراستنفورد، میگوید:«ما میتوانیم از سیستمهای هوش مصنوعی برای درک بهتر مغز و فهم انسانی و برعکس، استفاده کنیم».

یکی از روشهایی که تیم او با استفاده از آن این کار را انجام داده مدلسازی سیستم بصری انسان توسط هوش مصنوعی و بعد مقایسه مدلهای بهینهسازی شده با عملکرد حقیقی مغز برای اموری مانند تشخیص چهره، است.

در واقع در این تحقیقات از 4 اصل برای بررسی دیدار، شنیدار و سیستمهای موتوری، استفاده شده: کلاس معماری، وظیفه، مجموعه داده و قوانین یادگیری. این رویکرد کمک زیادی به تولد نظریههای جدید کرده است. مثلا این که چطور نوزادان از دادههای بصری بدون برچسب برای نمایش اشیاء استفاده میکنند.

این تیم همچنین مسیر دیگری را هم طی کرده است. از علوم شناختی تا هوش مصنوعی و همچنین استفاده از گرافهای سه بعدی برای مدلسازی شهودی فیزیک و پروسههای دیگر در هوش مصنوعی استفاده شده است. در حال حاضر هم یمینز در حال کار کردن روی ایجاد حس کنجکاوی در سیستمهای هوش مصنوعی است و برای این کار تحقیقاتی روی نحوه واکنش نشان دادن نوزادان به محیط اطرافشان، انجام داده است.

توسعه عمومیت بخشیدن با تمرینات کلی

با وجود این پیشرفت، اکتشافات پیشرفته از آزمایشگاه هوش مصنوعی تا اقدامات دنیای واقعی، میتواند چالشبرانگیز باشد. چلسی فین، استادیار کامپیوتر و مهندسی برق استنفورد، میگوید:«رباتها معمولا یاد میگیرند از یک شیء خاص در محیطی خاص استفاده کنند».

تیم او به اپلیکیشنهای هوش مصنوعی کمک میکند تا مانند انسانها عمومیت بخشیدن را یاد بگیرند. برای مثال، آنها متوجه شدند مجهز کردن رباتها به مشاهدات بصری میتواند باعث تسریع یادگیریهای مربوط به وظایف آنها مانند قرار دادن اشیاء در کشوها یا استفاده از ابزار برای ایجاد راههای جدید، شود. فین در این باره میگوید:«فقط کمی راهنمایی انسانی، بسیاری از راه را هموار میکند».

درکل، در معرض دادههای کلیتر قرار گرفتن باعث بالا رفتن کیفیت فرایند تعمیم میشود. حالا تیم فین در حال توسعه پایگاه دادهای با نام روبونت برای به اشتراکگذاری ویدئوهای مربوط به آموزش هستند. این پایگاه داده که بیش از 15 میلیون ویدئو دارد، قرار است به رباتها آموختن را یاد بدهد.

به سوی هوش منطقی مقیاسپذیر

«هوش منطقی Commonsense intelligence» منعکسکننده فاصله بین فهم انسان و ماشین است. همان فاصلهای که خیلیها دربارهاش صحبت کرده و سعی کردند آن را بپوشانند.

یجین چوی، پروفسور کامپیوتر و مهندسی دانشگاه واشنگتن، میگوید:«باید این که هوش انسانی دقیقا چطور کار میکند را مدلسازی کنیم».

برای مثال، سیستمهای هوش مصنوعی در کنار آمدن با مغایرتها دچار سردرگمی میشوند. مثلا این که گاهی به مواردی خارج از موجودی پایگاه دادهشان برمیخورند و برخی چراهای المانهای دیداری برایشان غیر قابل فهم است.

برای کمک به ماشینها با توسعه هوش منطقی، تیم چوی یک سیستم بصری دنبالهدار خلق کرده که از زبان طبیعی برای توصیف 60 هزار تصویر استفاده کرده است. هدف فعال کردن مدلهایی برای انتقال از زبان به اطلاعات است و به گفته چوی قرار است شبیه به زندگی روزانه انسان باشد. در نتیجه این اقدام سیستمهای هوش مصنوعی متوجه میشوند که مثلا چرا یک نفر یک عبارت بحثبرانگیز را در توئیتر منتشر میکند و قبل و بعد از آن چه اتفاقی میافتد.

چوی میگوید:«به جای مجموعه دادههایی برای انتخابهای متعدد، ما ایدههای اولیه را بدون حاشیه و به صورت مستقیم به ماشینها یاد میدهیم».

اوده اولیوا، مدیر آزمایشگاه هوش مصنوعی MIT_IBM Watson، فرد دیگری است که در حال کار کردن روی اشیاء منطق – محور و تعلیم دادن علوم شناختی به مدلهای هوش مصنوعی است. اولیویا میگوید:«در اطلاعات پایهای علوم عصبشناسی، نکات طلایی زیادی برای به کار بردن در مدلهای هوش مصنوعی وجود دارد».

برای مثال، پروژههای آزمایشگاهی مومنتس این تایم Moments in Time، از پایگاه داده وسیعی شامل ویدئوهای 3 ثانیهای استفاده میکند تا به شبکههای عصبی تجسم تصاویر فعالیتهایی مانند خوردن، امضا کردن و تعقیب کردن را آموزش دهد. در نتیجه آن، مدلهای آموزش داده شده میتوانند مواردی مانند رقابت یا تمرین کردن را هم یاد بگیرند.

برای این که بهتر متوجه شویم که انسانها چطور یاد میگیرند و بعد آموختههایمان را به هوش مصنوعی آموزش دهیم، تیم اولیویا تصاویر مغزی را بررسی میکند. با این بررسی مشخص میشود که در زمان دیدن، شنیدن، به دست آوردن سرنخ و دیگر فعالیتها، کدام قسمت مغز فعال میشود و از طریق نتایج این مشاهدات میتوان سیستمهای هوش مصنوعی فعالتر را توسعه داد. اولیویا میگوید:«در حال یادگیری اصول رایج بین شناخت انسان و هوش مصنوعی هستیم».

جوشوا تننبوم، پروفسور علوم شناختی پردازشی کالج MIT اولیویا، به دنبال مقیاس کردن یادگیری هوش مصنوعی و درک تاثیرات استفاده از مدلهای الهام گرفته از انسان است:«اگر بتوانیم هوشی بسازیم که مثل یک بچه در حال رشد باشد و مدام در حال بالغتر شدن باشد چه؟».

تیم او در حال استفاده از طرحهای اولیه پیشرفتی مبتنی بر روانشناسی برای مهندسی معکوس کردن هسته منطق و به کار گرفتن برنامههایی احتمالی برای ساختن سیستم هوش مصنوعی با معماری شبیه به نوع انسانی آن است:«میخواهیم «موتور بازی» داخل سر شما را شبیهسازی کنیم». او اشاره به سرعت بالای مغز انسان در پردازشها دارد.

آنها موقعیت موتور فیزیکی مغز را شناسایی کردند و شبکه عصبیای خلق کردند که میتواند سیستم بصری انسان را بهتر تقلید کند. این سیستم مشخص میکند که پلتفرمهای هوش مصنوعی پیشرفت خوبی از نظر انعطافپذیری، مقیاسپذیری و توانایی استنباطهای بی سابقه و واکنش کردهاند. مثل دریم کودر DreamCoder، سیستمی که میتواند نقاشیهای پیچیده را خلق کند.

یادگیری همزمان با حفاظت از حریم خصوصی

هنوز هم یکی از چالشهای یادگیری عمیق مربوط به حریم شخصی دادهها است. سانجیو آرورا، پروفسور علوم کامپیوتری پرینستون، میگوید:«ما از دادهها برای لذت بردن از دنیایی که کاملا برای ما سفارشی شده، استفاده میکنیم».

مطالعات او در زمینه آموزش یادگیری عمیق بدون افشای دادههای شخصی است. اینجا استراتژیهای ایجاد شده مانند حریم خصوصی و رمزگذاری افتراقی، بهرهوری و دقت را قربانی میکند.

اینستاهاید InstaHide، سیستمی که آرورا آن را توسعه داده، تصاویر را برای مدلهای هوش مصنوعی تمرینی رمزگشایی میکند، آن هم در حالی که به دقت و بهرهوری آن کاملا توجه میشود. این سیستم تصاویر شخصی را با تصاویر عمومی ادغام میکند و رنگ پیکسلها را به صورت تصادفی تغییر میدهد. مدل مشابهی هم برای دادههای مبتنی بر متن به کار برده شده که محتوای متنی و نمودارها را رمزگشایی میکند.

آرورا میگوید:«سیستمها نزدیک به 100% دقت دارند و از دارو گرفته تا ماشینهای خودران، میتواند به حفظ حریم شخصی دادهها هم کمک کند.

سهزاویهای کردن هوش در استنفورد

بسیاری از افراد دانشگاه استنفورد به این موضوع اشاره کردند که سهزاویهای کردن هوش اولویت کل دنیا شده است. مایکل فرانک، پروفسور بیولوژی انسانی مدیر برنامه سیستمهای سمبلیک و بیل نیوسام، پروفسور عصب شناسی و مدیر موسسه عصب شناسی وو تسای، توضیح دادند که شرکتهایشان در این زمینه چطور قدم برداشتهاند.

دانشجویان استنفورد این امکان را دارند که رشته سیستمهای سمبلیک با گرایش هوش مصنوعی مبتنی بر انسانیت را انتخاب کنند. در کلاسهای این رشته مسائل اخلاقی دیجیتال، سیاستها و خط مشی الگوریتمها و طراحیهای هوش مصنوعی آموزش داده میشود.

فرانک میگوید:«سیستمهای سمبلیک یک رشته منحصربهفرد است که تحصیلات میانرشتهای در زمینه پردازش، فلسفه و علوم شناختی ارائه میدهد». این رشته که از سال 1986 شروع شده و با دانشآموختگانی مانند بنیانگذارهای لینکدین و اینستاگرام به خود میبالد، یک دوره مقدماتی به نام «ذهنها و ماشینها Minds and Machines» دارد.

نیوسام میگوید:«مغز مشکلی بزرگتر از آن است که با هر خط مشی یا فناوریهای تجربی حل شود». به همین دلیل هم هست که موسسه وو تسای سرمایهگذاری خوبی روی بورسیههای میانرشتهای و تحقیقات کرده است.

اولویتهای دیگر استنفورد رشتههایی چون رشته هافمن یی گرانت Hoffman-Yee grant program است که در آن محققان میانرشتهای را دور هم جمع میکند تا نظریهای ارزشمند مبتنی بر اکوسیستمی جامع در تقاطع هوش مصنوعی، علم عصبشناسی و روانشناسی خلق کند.