ویژهنامه هوش مصنوعی ساینتیفیک امریکن

ChatGPT «توهم» نمیزند؛ چرتوپرت میگوید!

هنگام بحث درباره اینکه چتباتهای هوش مصنوعی چگونه اطلاعات را میسازند، استفاده از اصطلاحات دقیق مهم است.

امروزه هوش مصنوعی همهجا هست. وقتی سندی مینویسید، احتمالاً از شما پرسیده میشود که آیا به «دستیار هوش مصنوعی» خود نیاز دارید یا خیر. یک PDF را باز کنید و ممکن است از شما پرسیده شود که آیا میخواهید هوش مصنوعی خلاصهای برایتان آماده کند. اما اگر از ChatGPT یا مشابههایش استفاده کرده باشید، احتمالاً با مشکل خاصی آشنا هستید؛ آنها مطالب را از خودشان درمیآورند که باعث میشود کاربران به چیزهایی که میگویند با سوءظن نگاه کنند.

«توهم» یا واژهای گمراهکننده؟

این نوع خطا به اصطلاح «توهم» (Hallucination) معروف شده است؛ اما صحبتکردن درباره ChatGPT به این شیوه گمراهکننده و بهطور بالقوه مخرب است. در عوض آن را «چرند» بنامید. (نویسندگان از واژه «Bullshit» استفاده کردهاند.)

ریشه فلسفی یک اصطلاح جنجالی

ما بیدلیل چنین اصطلاحی را به کار نمیبریم. چرند در میان فیلسوفان معنای تخصصی دارد؛ معنایی که توسط «هری فرانکفورت» (Harry Frankfurt) فیلسوف فقید آمریکایی رواج یافت. وقتی کسی چرند میگوید، حقیقت را نمیگوید؛ اما واقعاً دروغ هم نمیگوید. فرانکفورت گفت آنچه چرندگو را متمایز میکند این است که او صرفاً اهمیتی نمیدهد که آنچه میگوید درست است یا نه. ChatGPT و همتایانش نمیتوانند اهمیت بدهند؛ بنابراین آنها از نظر فنی ماشینهای چرندگو هستند.

بهراحتی میتوانیم ببینیم چرا چنین چیزی صحیح است و چرا اهمیت دارد. برای مثال، در سال ۲۰۲۳ یک وکیل وقتی از ChatGPT در تحقیقات خود هنگام نوشتن یک لایحه حقوقی استفاده کرد، خودش را در دردسر بزرگی انداخت.ChatGPT متأسفانه ارجاعات جعلی و پروندههایی را استناد کرده بود که اصلاً وجود نداشتند.

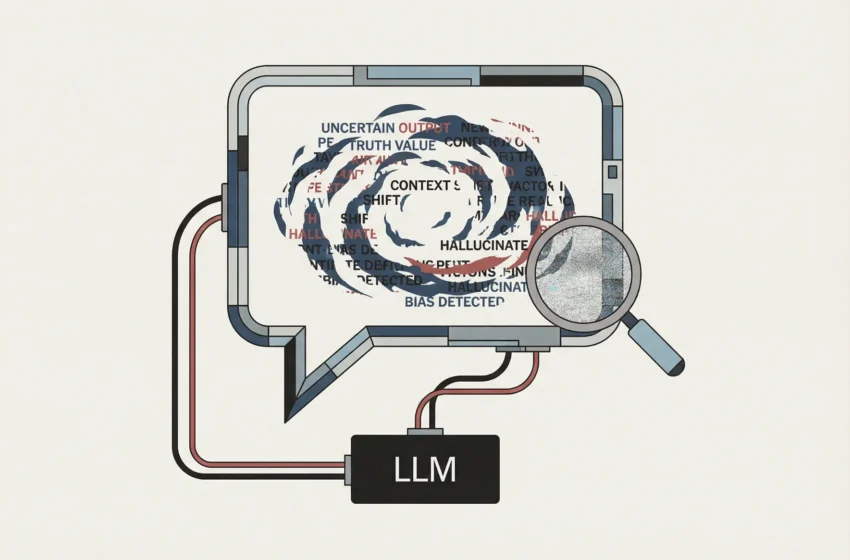

پشتصحنه فنی: مدلهای زبانی چگونه کار میکنند؟

این نتیجه نادر یا غیرعادی نیست. برای درک چرایی آن، بهتر است کمی درباره نحوه کار این برنامهها فکر کنیم. چتباتهای ChatGPT و Gemini و مدل Llama شرکت متا همگی به روشهای ساختاری مشابهی کار میکنند. در هسته آنها یک مدل زبانی بزرگ یا LLM قرار دارد. این مدلها همگی پیشبینیهایی درباره زبان انجام میدهند. با دادن مقداری ورودی، ChatGPT پیشبینی خاصی درباره اینکه چه چیزی باید در ادامه بیاید یا پاسخ مناسب چیست، انجام میدهد. این کار را از طریق تجزیهوتحلیل دادههای آموزشی خود انجام میدهد که شامل مقادیر عظیمی از متن است. در مورد ChatGPTدادههای آموزشی اولیه شامل میلیاردها صفحه متن از اینترنت بود.

با دادن قطعهای متن یا همان پرامپت، مدل زبانی بزرگ از دادههای آموزشی خود استفاده میکند تا پیشبینی کند چه چیزی باید در ادامه بیاید. این مدل به فهرستی از محتملترین کلمات یا از نظر فنی همان توکنهای زبانی که باید در ادامه بیایند میرسد. سپس یکی از بهترین گزینهها را انتخاب میکند. اینکه به مدل اجازه بدیم هر بارئصرفاً فقط محتملترین کلمه را انتخاب نکند، زبانی خلاقانهتر و شبیهتر به انسان را امکانپذیر میکند. پارامتری که میزان انحراف مجاز را تعیین میکند بهعنوان «تمپرچر» (Temperature) شناخته میشود که بیانگر سطح خلاقیت، درجه تصادفی بودن و ضریب تنوع پاسخهای مدل است. (در متون تخصصی فارسی برای اصلاح «Temperature» از ارائه ترجمه مستقیم و استفاده از واژه «دما» به دلیل کژتابی معنایی آن خودداری میشود و اکثراً از شکل فارسینویسیشده «تمپرچر» یا توصیف کلی آن استفاده میشود) در مراحل بعدی فرایند، ناظران انسانی پیشبینیها را با قضاوت در مورد اینکه آیا خروجیها گفتار معقولی را تشکیل میدهند یا نه اصلاح میکنند. محدودیتهای اضافی نیز ممکن است روی برنامه قرار داده شود تا از بروز برخی مشکلات جلوگیری شود (مانند اظهارات نژادپرستانه)، اما این پیشبینی توکنبهتوکن، ایدهای است که زیربنای این فناوری را تشکیل میدهد.

فقدان پیوند ذاتی با واقعیت

حال، ما از این توصیف میتوانیم ببینیم که هیچچیز در مورد مدلسازی تضمین نمیکند که خروجیها بهدقت چیزی را در جهان توصیف کنند. دلایل زیادی وجود ندارد که فکر کنیم خروجیها اصلاً به هر نوعی بازنمایی درونی متصل هستند. یک چتبات که بهخوبی آموزشدیده، متنی شبیه انسان تولید میکند؛ اما هیچچیزی در این فرایند بررسی نمیکند که آیا متن درست است یا نه و به همین دلیل است که ما قویاً شک داریم که یک مدل زبانی بزرگ واقعاً آنچه را که میگوید، میفهمد.

بنابراین گاهی اوقات ChatGPT چیزهای نادرستی میگوید. در سالهای اخیر، همانطور که ما به هوش مصنوعی عادت کردهایم، افراد نیز این اشتباهات را «توهمات هوش مصنوعی» ارجاع میدهند. هرچند یک عبارت استعاری است، اما ما فکر میکنیم استعاره خوبی نیست.

توهم پارادایماتیک (نمونهای) شکسپیر را در نظر بگیرید که در آن مکبث خنجری را میبیند که به سمت او شناور است. اینجا چه خبر است؟ مکبث سعی دارد از ظرفیتهای ادراکی خود به روش معمول استفاده کند، اما مشکلی پیش آمده است. ظرفیتهای ادراکی او تقریباً همیشه قابلاعتماد هستند؛ او معمولاً خنجرهایی را نمیبیند که به طور تصادفی در اطراف شناور باشند! معمولاً بینایی او در بازنمایی جهان کارایی است و به دلیل ارتباطش با جهان، این کار را بهخوبی انجام میدهد.

حالا به ChatGPT فکر کنید. هر زمان که چیزی میگوید، صرفاً تلاش میکند متنی شبیه انسان تولید کند. هدف فقط ساختن چیزی است که خوب به نظر برسد. این تلاش هرگز مستقیماً به جهان گره نخورده است. وقتی همه چیز اشتباه پیش میرود، به این دلیل نیست که ChatGPT در بازنمایی جهان در آن زمان خاص موفق نشده است؛ بلکه او هرگز سعی نمیکند جهان را بازنمایی کند! نامیدن نادرستیهایش بهعنوان «توهم» این جنبه را نشان نمیدهد.

چرا «چرند» اصطلاح دقیقتری است؟

ما در گزارشی در سال ۲۰۲۴ در نشریه Ethics and Information Technology پیشنهاد کردیم که «چرند» اصطلاح بهتری است. همانطور که ذکر شد، یک چرندگو اهمیت نمیدهد که آنچه میگوید درست است یا نه.

اگر ما ChatGPT را در تعامل گفتوگویی با خودمان در نظر بگیریم؛ اگرچه حتی این ایده هم ممکن است کمی وانمودکردن باشد، پس به نظر میرسد این اصطلاح مناسب باشد. تاحدیکه ChatGPT قصد انجام هر کاری را داشته باشد، قصد دارد متنی متقاعدکننده و شبیه انسان تولید کند. او سعی نمیکند چیزهایی درباره جهان بگوید. او فقط دارد چرند میگوید و نکته حیاتی این است که حتی وقتی چیزهای درست میگوید هم دارد چرند میگوید.

چرا این تمایز مهم است؟ آیا «توهم» در اینجا فقط یک استعاره زیبا نیست؟ آیا واقعاً مهم است که مناسب نباشد؟ حداقل به سه دلیل گمان میکنیم مهم است.

اول، اصطلاحاتی که استفاده میکنیم بر درک عمومی از فناوری تأثیر میگذارد که به نوبه خود مهم است. اگر از اصطلاحات گمراهکننده استفاده کنیم، احتمال بیشتری دارد که مردم نحوه کار فناوری را اشتباه درک کنند. ما فکر میکنیم این خطر بهخودیخود چیز بدی است.

دوم، نحوه توصیف ما از فناوری بر رابطه ما با آن فناوری و نحوه تفکر ما درباره آن تأثیر میگذارد و این تصورات میتوانند مضر باشند. افرادی را در نظر بگیرید که با خودروهای «خودران» به حس امنیت کاذب فرورفتهاند. ما نگرانیم که صحبت از «توهم زدن» هوش مصنوعی اصطلاحی معمول در روانشناسی انسان است، خطر «انسانانگاری» (Anthropomorphizing) چتباتها را در پی داشته باشد. «اثر الیزا» (The ELIZA Effect) که نامش از یک چتبات دهه ۱۹۶۰ گرفته شده زمانی رخ میدهد که مردم ویژگیهای انسانی را به برنامههای کامپیوتری نسبت میدهند. ما این اثر را در حالت افراطی در یک کارمند گوگل دیدیم که به این باور رسید که یکی از چتباتهای این شرکت دارای احساسات است. توصیف ChatGPT بهعنوان یک ماشین چرند، حتی اگر ماشینی بسیار تحسینشده باشد به کاهش این خطر کمک میکند.

سوم، اگر ما عاملیت (Agency) را به برنامهها نسبت دهیم؛ ممکن است وقتی مشکلاتی پیش میآید، تقصیر را از گردن کاربران یا برنامهنویسان برداریم. اگر آنطور که به نظر میرسد این نوع فناوری روزبهروز بیشتر در مسائل مهمی مانند مراقبتهای سلامت استفاده شود؛ بسیار حیاتی است که بدانیم وقتی همه چیز اشتباه پیش میرود چه کسی مسئول است.

بنابراین دفعه بعد که دیدید کسی مصنوعات هوش مصنوعی را بهعنوان «توهم» توصیف میکند، بگویید چرند است!